在 Ubuntu 下基于 Claude Code + DeepSeek V3.2 构建智能终端开发环境

前言

在当今的软件工程实践中,将大型语言模型(LLM)直接集成到本地开发环境,已经成为提升研发效率的重要方式。 相比传统“复制 → 粘贴 → 调试”的工作流,基于终端的 AI 开发助手可以直接理解代码上下文、执行系统命令, 并参与完整的软件生命周期。

Claude Code 是 Anthropic 推出的新一代命令行 AI 辅助工具,它不仅能够理解整个代码仓库, 还具备执行 Shell 命令、创建文件和修改工程结构的能力。 而 DeepSeek V3.2 作为当前推理与代码能力表现突出的模型之一, 通过兼容 OpenAI 协议的 API,可以无缝接入 Claude Code 作为其推理后端。

本文将从零开始,完整讲解如何在 Ubuntu 环境下构建一个 基于 Claude Code、底层模型为 DeepSeek V3.2 的智能终端开发环境。 整个过程涵盖系统环境准备、Node.js 运行时部署、CLI 工具安装、API 网关配置、 自动化脚本封装以及最终的终端智能体实战。

第一阶段:底层系统环境构建

任何稳定的开发环境,都必须从操作系统的基础状态开始。 在部署 Node.js、本地编译模块或 Python 扩展库之前, 需要确保系统的软件源索引和核心构建工具是最新的。

首先更新 APT 软件源索引,并升级已安装的软件包。 随后安装常见但必不可少的基础工具:

- curl:用于下载远程脚本和 API 请求

- git:用于代码版本管理

- build-essential:包含 GCC、G++ 和 make

- libssl-dev:SSL 相关开发库

sudo apt update && sudo apt upgrade -y

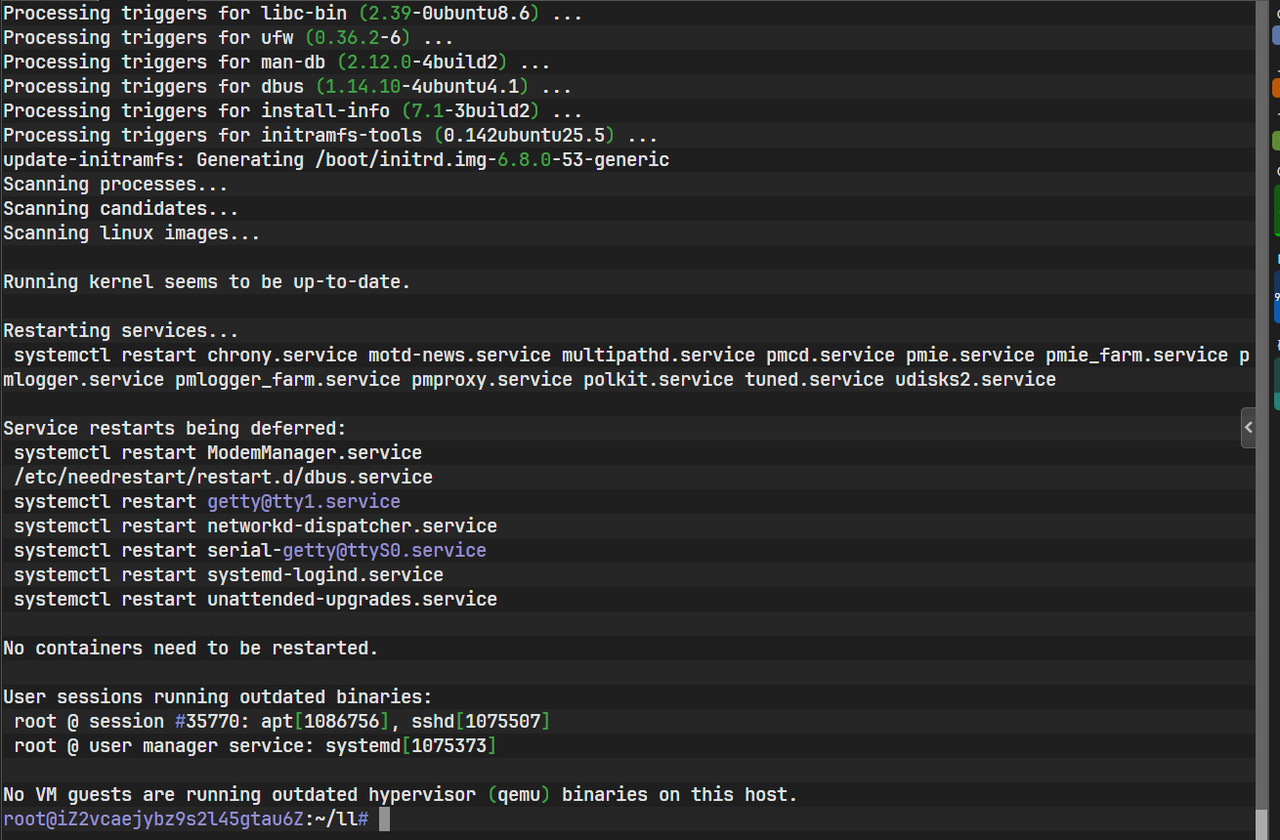

sudo apt install -y curl git build-essential libssl-dev执行上述指令后,APT 包管理器会解析依赖树并下载相应的数据包。

上图展示了基础依赖包安装完成后的终端状态。

执行完成后,系统已经具备了编译原生模块和运行现代 Web 工具的能力,为后续 Node.js 和 AI CLI 工具的安装打下基础。

第二阶段:Node.js 运行时环境部署

Claude Code 本质上是一个基于 JavaScript / TypeScript 的命令行工具, 因此 Node.js 运行时是其最基本的前置条件。

Ubuntu 默认软件源中的 Node.js 版本通常较旧, 为了避免兼容性问题,推荐使用 NodeSource 官方提供的二进制安装源, 直接安装长期支持版本(LTS)的 Node.js 20.x。

curl -sL https://deb.nodesource.com/setup_20.x | sudo -E bash -

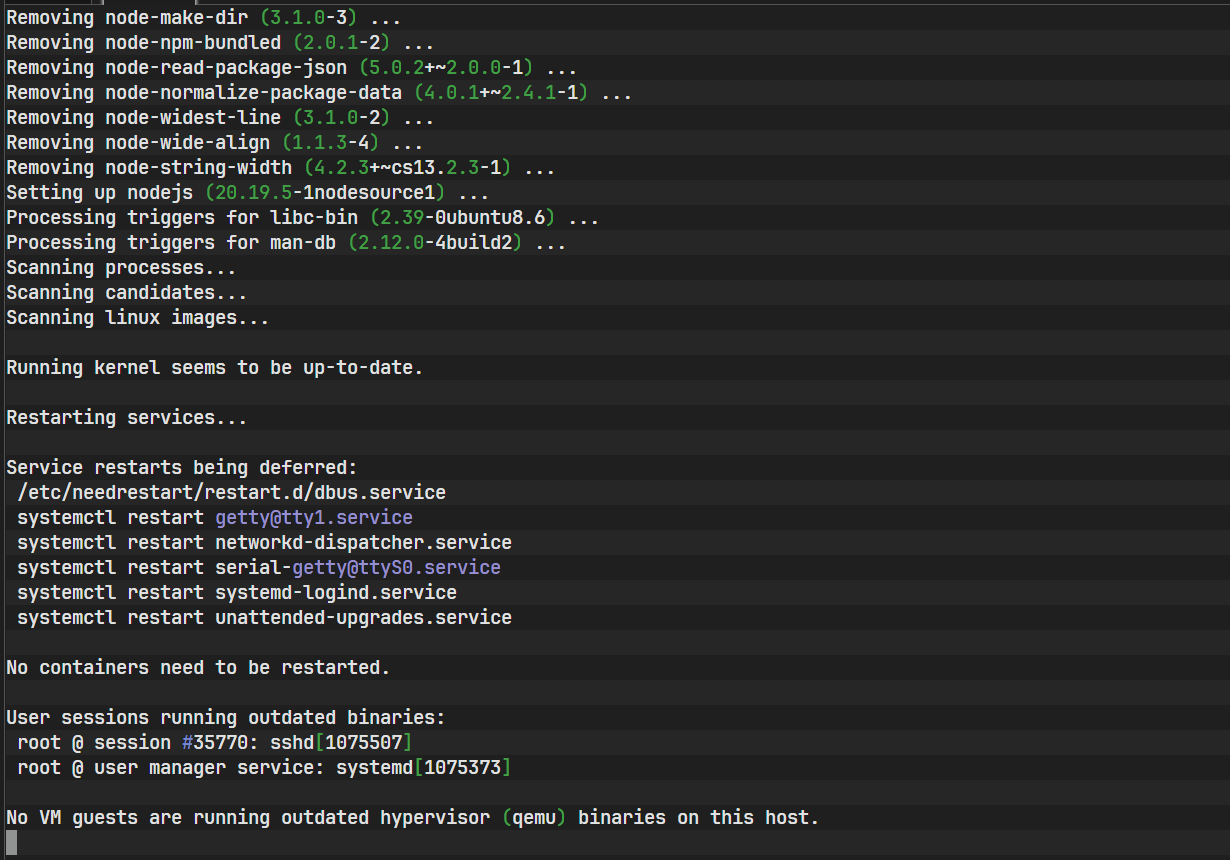

sudo apt-get install -y nodejs该步骤会同时安装 Node.js 和 npm。 安装完成后,可以通过查看版本号确认环境是否生效:

上图记录了通过 NodeSource 脚本配置源并完成安装的过程。

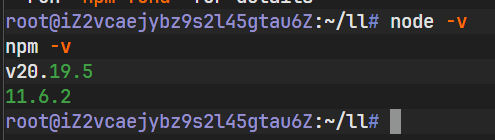

node -v

npm -v

如上图所示,终端输出了 Node.js 的版本号。如果终端正确输出版本号,说明 JavaScript 运行环境已经就绪。

第三阶段:Claude Code 工具安装与初始化

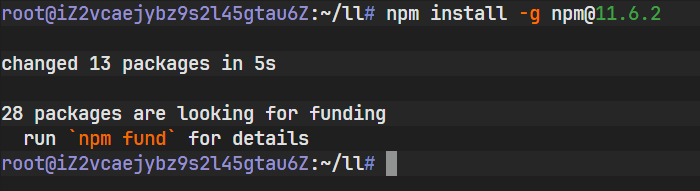

Claude Code 以全局命令行工具的形式存在, 因此需要使用 npm 的全局安装模式进行安装。

npm install -g @anthropic-ai/claude-code

安装完成后,claude 命令会被注册到系统路径中,

可以在任意目录直接调用。

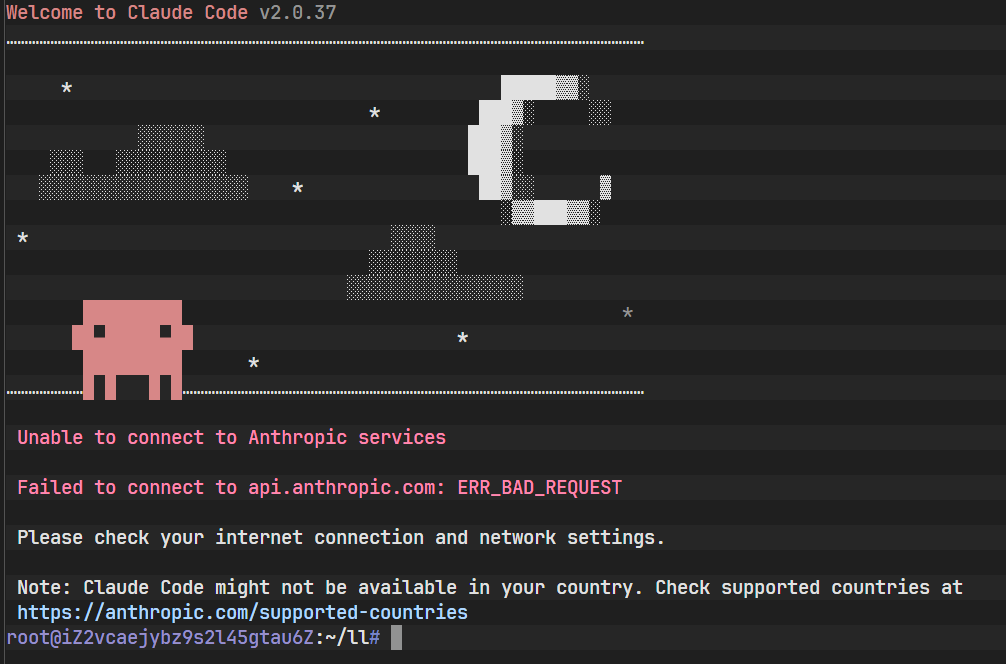

此时如果直接运行 claude,通常会出现连接错误。

这是因为工具默认尝试访问 Anthropic 官方 API,

而当前尚未配置任何 API 端点或鉴权信息。

这一步的报错恰恰说明:工具本身已经安装成功, 接下来需要做的只是“告诉它该去哪里调用模型”。

上图展示了首次尝试运行 claude 命令时的报错信息。系统提示连接错误或未授权,这验证了工具本身已安装成功,但缺乏必要的网络配置与鉴权信息。这引入了环境搭建中最关键的环节——环境变量配置。

第四阶段:API 网关配置与鉴权机制

Claude Code 支持通过环境变量覆盖默认 API 配置, 这使得它可以适配所有兼容 OpenAI 接口规范的第三方模型服务。

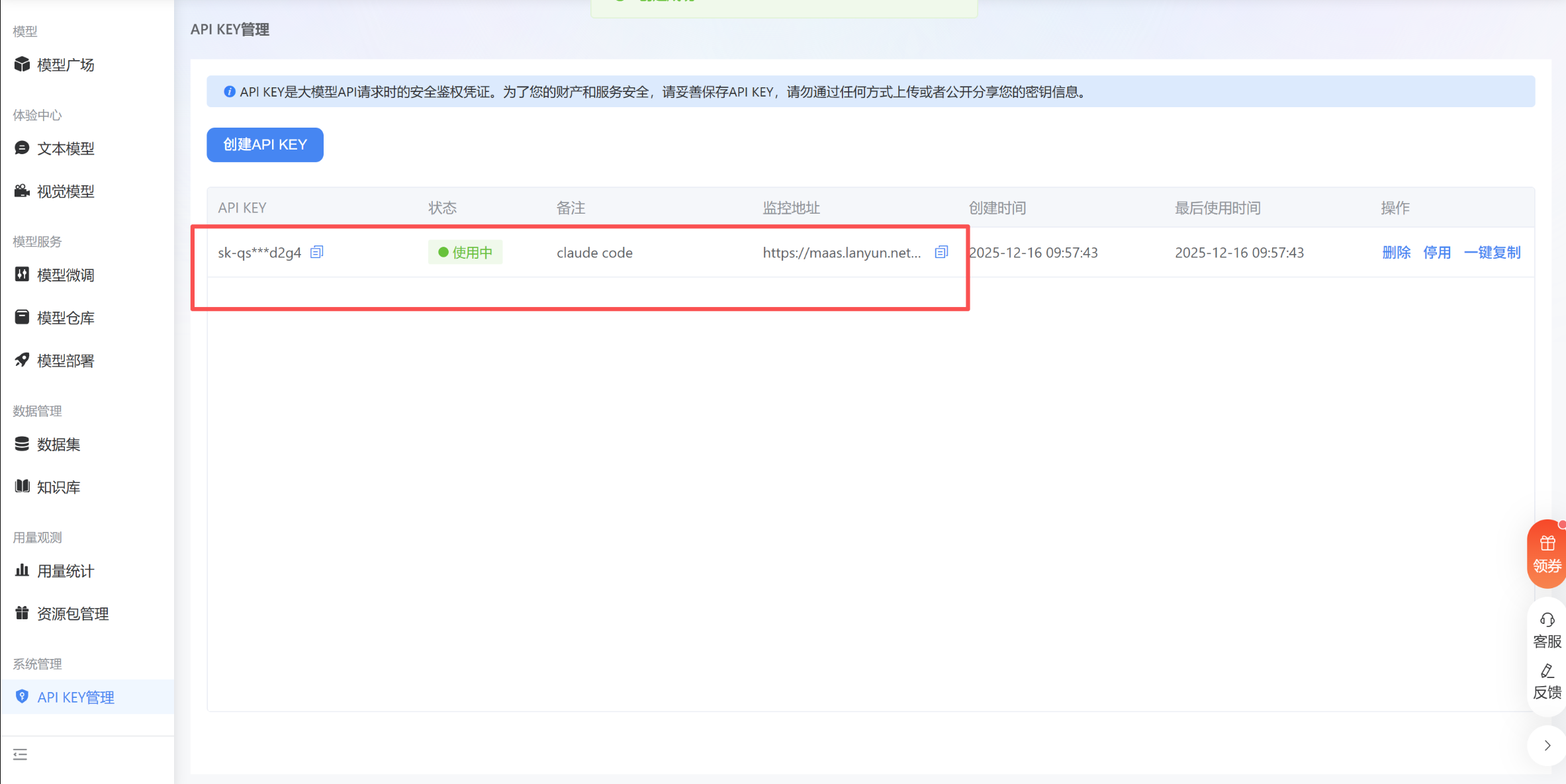

首先,需要访问蓝耘控制台获取 API 密钥(API Key)。该密钥是验证用户身份及计费的唯一凭证。

获取密钥后,需要将其注入到用户的 Shell 配置文件中。

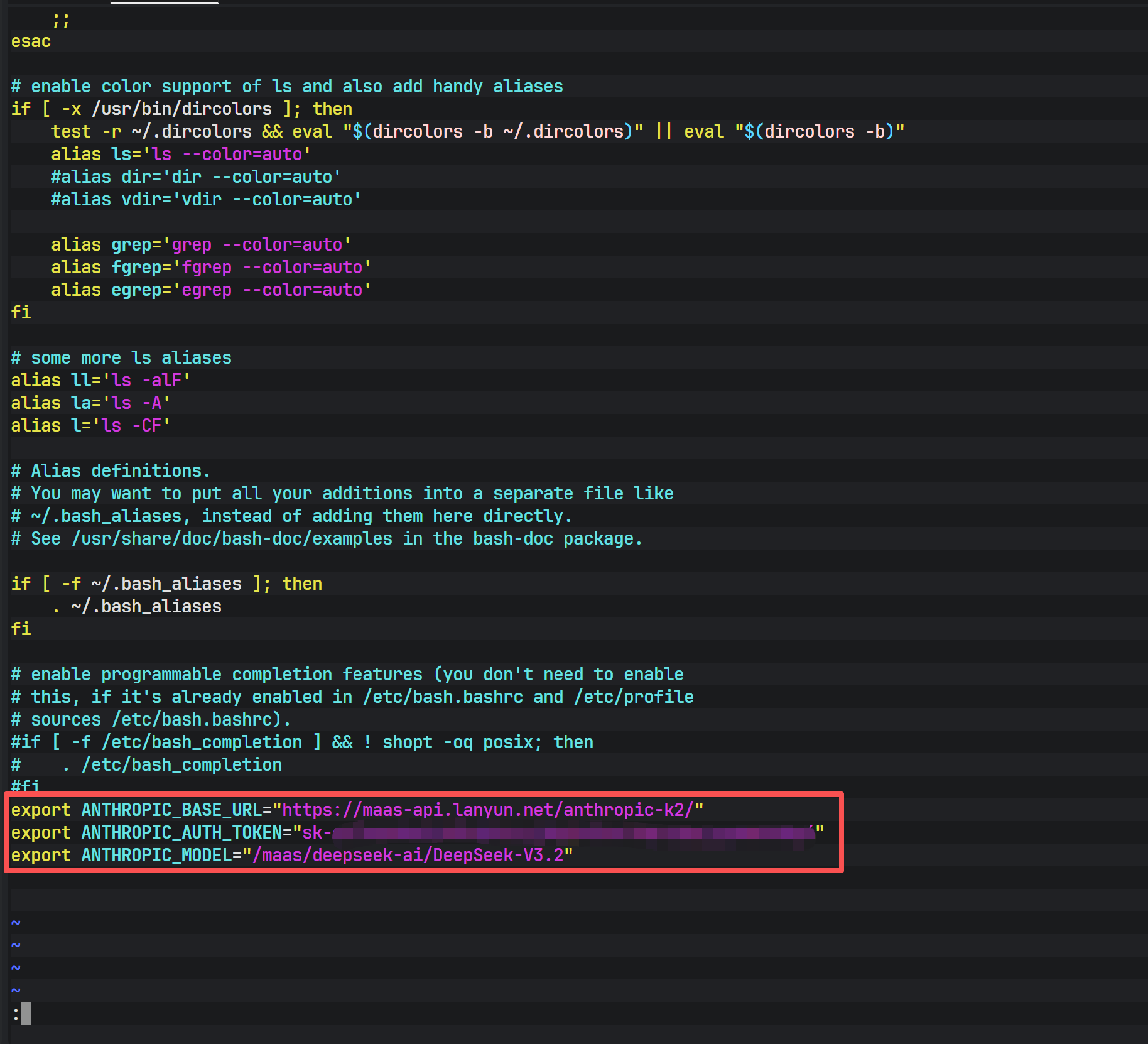

为了使用蓝耘(Lanyun)托管的 DeepSeek V3.2, 需要在 Shell 环境中配置以下三个核心变量:

- ANTHROPIC_BASE_URL:API 网关地址

- ANTHROPIC_AUTH_TOKEN:API Key

- ANTHROPIC_MODEL:模型 ID

echo 'export ANTHROPIC_BASE_URL="https://maas-api.lanyun.net/anthropic-k2/"' >> ~/.bashrc

echo 'export ANTHROPIC_AUTH_TOKEN="sk-xxxxxxxxxxxxxxxx"' >> ~/.bashrc

echo 'export ANTHROPIC_MODEL="/maas/deepseek-ai/DeepSeek-V3.2"' >> ~/.bashrc

通过 echo 和重定向符号 >> 将上述配置追加至配置文件末尾,可确保配置的持久化,即使用户退出终端或重启系统,配置依然有效。

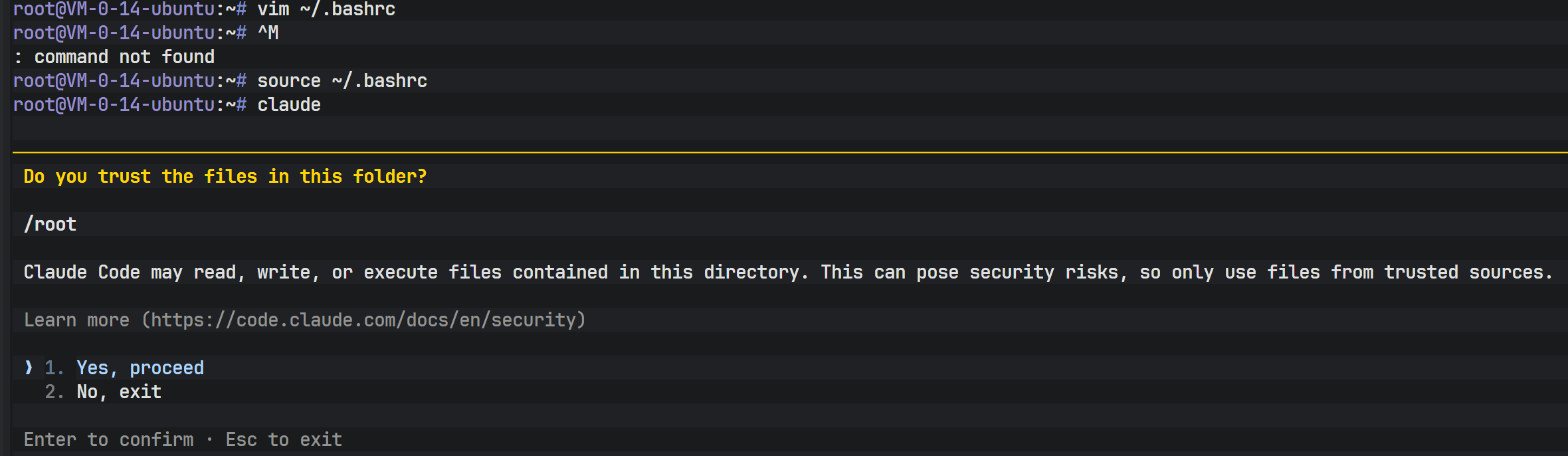

修改完成后,需要立即加载配置:

source ~/.bashrc

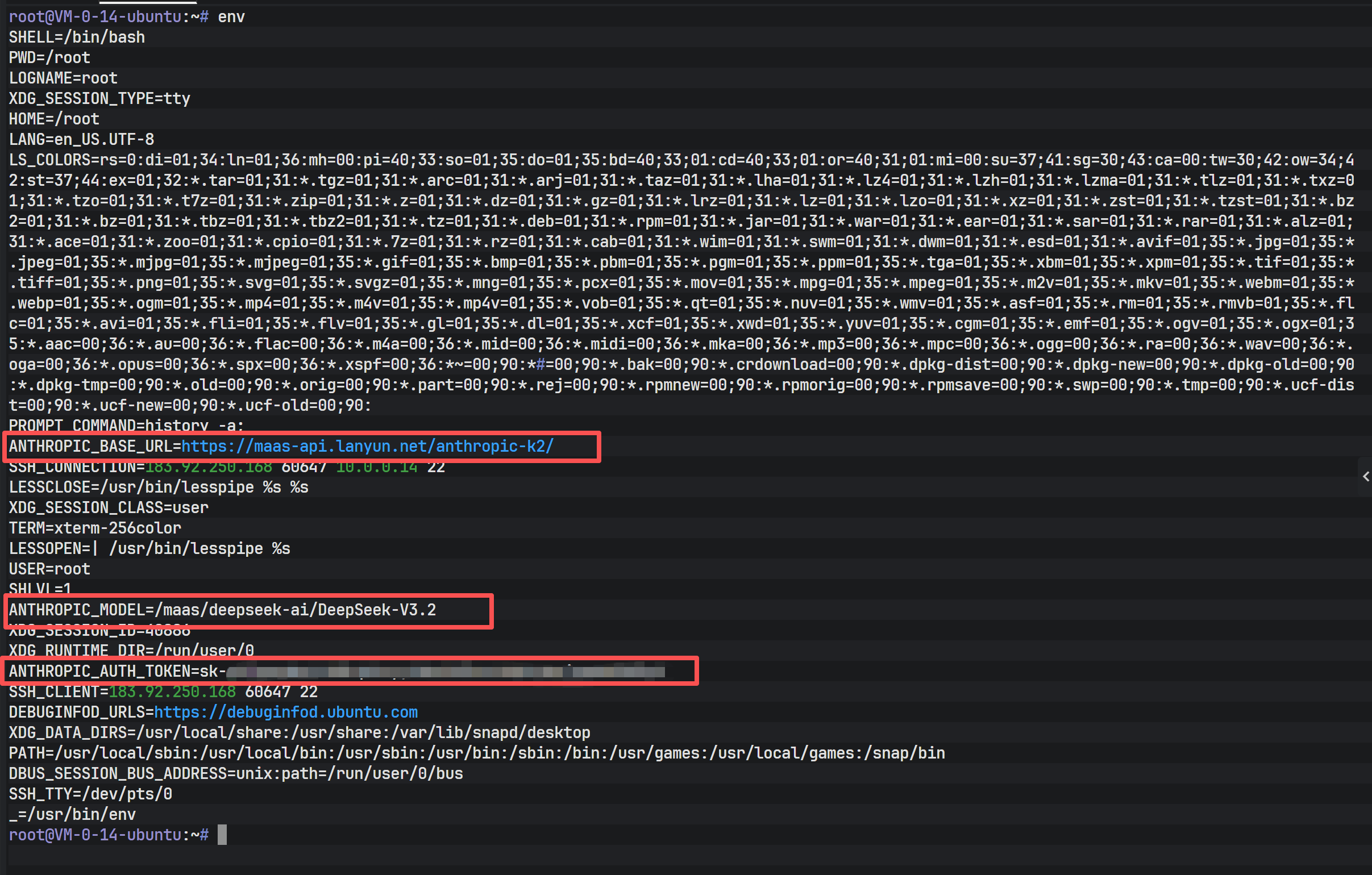

通过 env 命令输出的环境变量列表如上图所示,系统中已存在 ANTHROPIC_ 开头的相关配置,且值与设定一致。此时,Claude Code 已具备了与服务端通信的所有必要条件。

此时再次运行 claude,

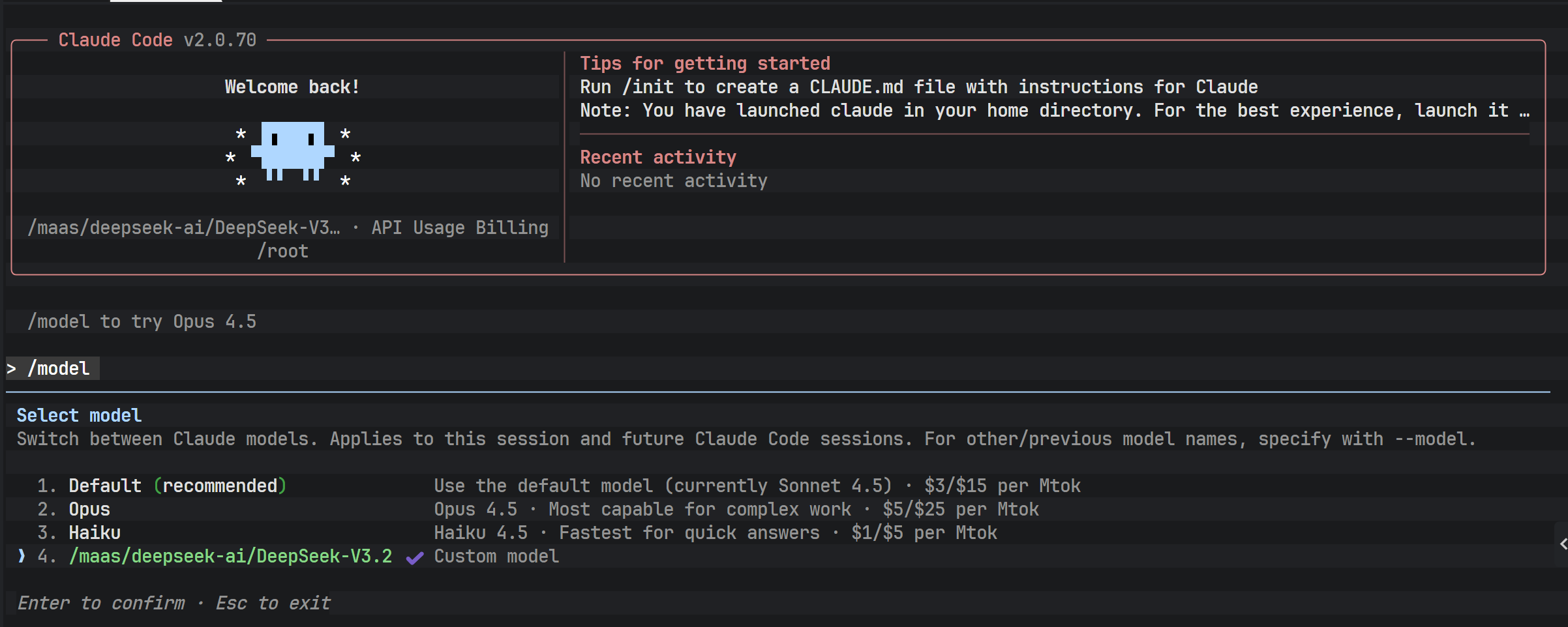

工具将成功连接至 DeepSeek V3.2 并进入交互模式。

在成功连接后,可以通过工具内置的命令查看当前配置的模型信息。

确认模型标识符与配置文件中的设定一致,标志着 API 路由已成功指向 DeepSeek V3.2。

第五阶段:自动化部署脚本的实现

在多台服务器或多环境部署时, 重复手动配置不仅低效,也容易出错。 因此,编写一个自动化安装脚本是工程化的最佳实践。

完整的安装脚本通常包含以下能力:

- 检测操作系统类型

- 检测 Node.js 是否存在及版本是否达标

- 自动安装或升级 Node.js

- 检测 Claude Code 是否已安装

- 安全读取 API Key(不回显)

- 幂等方式修改 Shell 配置文件

./install.sh执行脚本后,用户只需按照提示输入 API Key, 即可完成全部环境部署。

上图展示了运行安装脚本时的交互界面,脚本自动识别了 Node.js 环境并跳过了重复安装,随后提示用户输入 API 密钥。

第六阶段:终端智能体的开发与 API 调用测试

环境准备完成后,进入实战阶段。 此时 Claude Code 已经可以作为“开发代理”, 直接根据自然语言需求生成代码并执行系统操作。

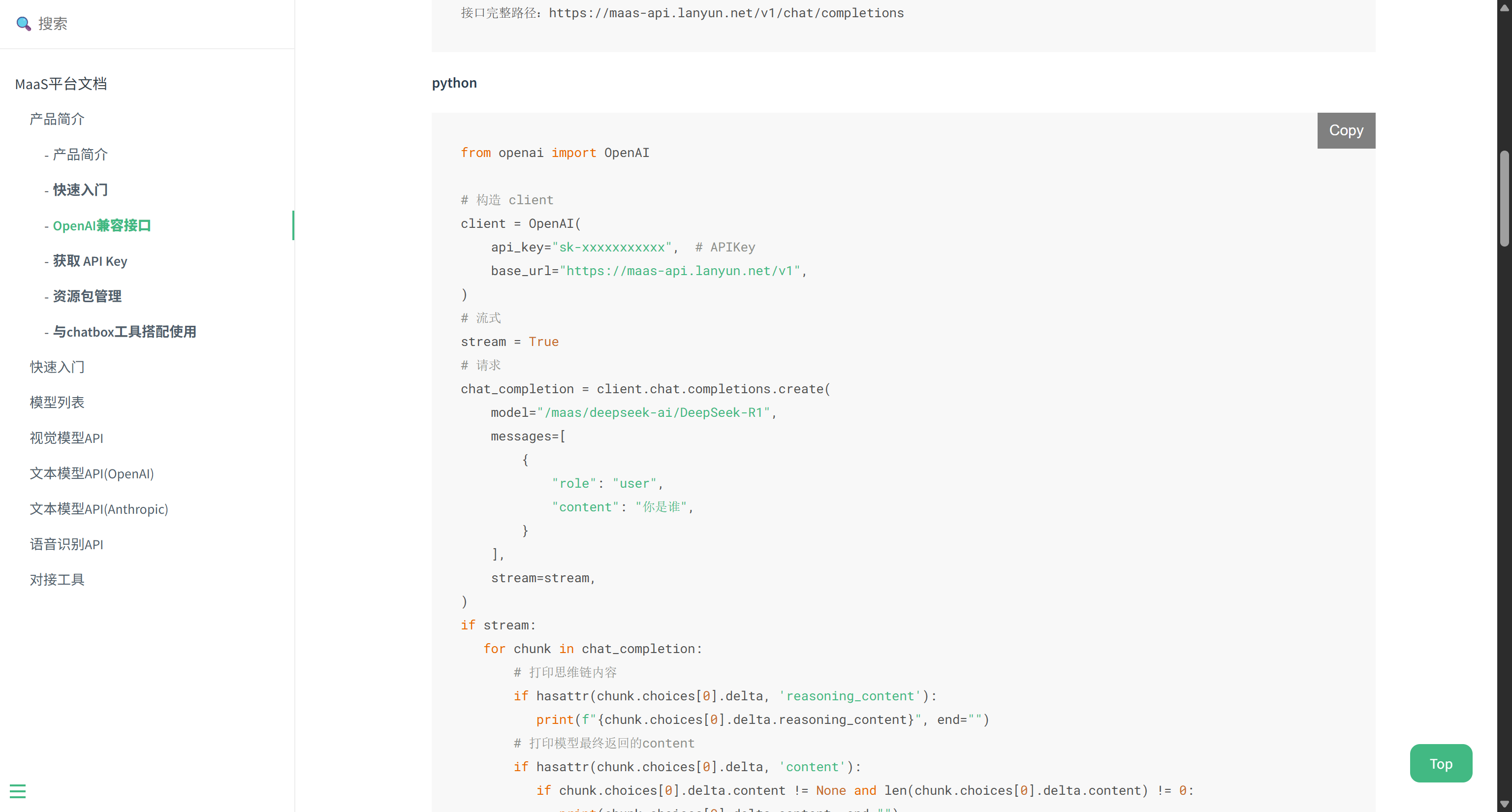

为了验证 DeepSeek V3.2 的能力, 可以构建一个基于 OpenAI Python SDK 的终端智能体。

from openai import OpenAI

client = OpenAI(

api_key="sk-xxxxxxxx",

base_url="https://maas-api.lanyun.net/v1",

)

chat_completion = client.chat.completions.create(

model="/maas/deepseek-ai/DeepSeek-V3.2",

messages=[

{"role": "user", "content": "你是谁"}

],

stream=True,

)

for chunk in chat_completion:

if hasattr(chunk.choices[0].delta, 'reasoning_content'):

print(chunk.choices[0].delta.reasoning_content, end="")

if hasattr(chunk.choices[0].delta, 'content'):

print(chunk.choices[0].delta.content or "", end="")该示例展示了流式响应的处理方式, 可以实时输出模型的推理过程和最终回答, 非常适合构建低延迟、强交互的终端 AI 工具。

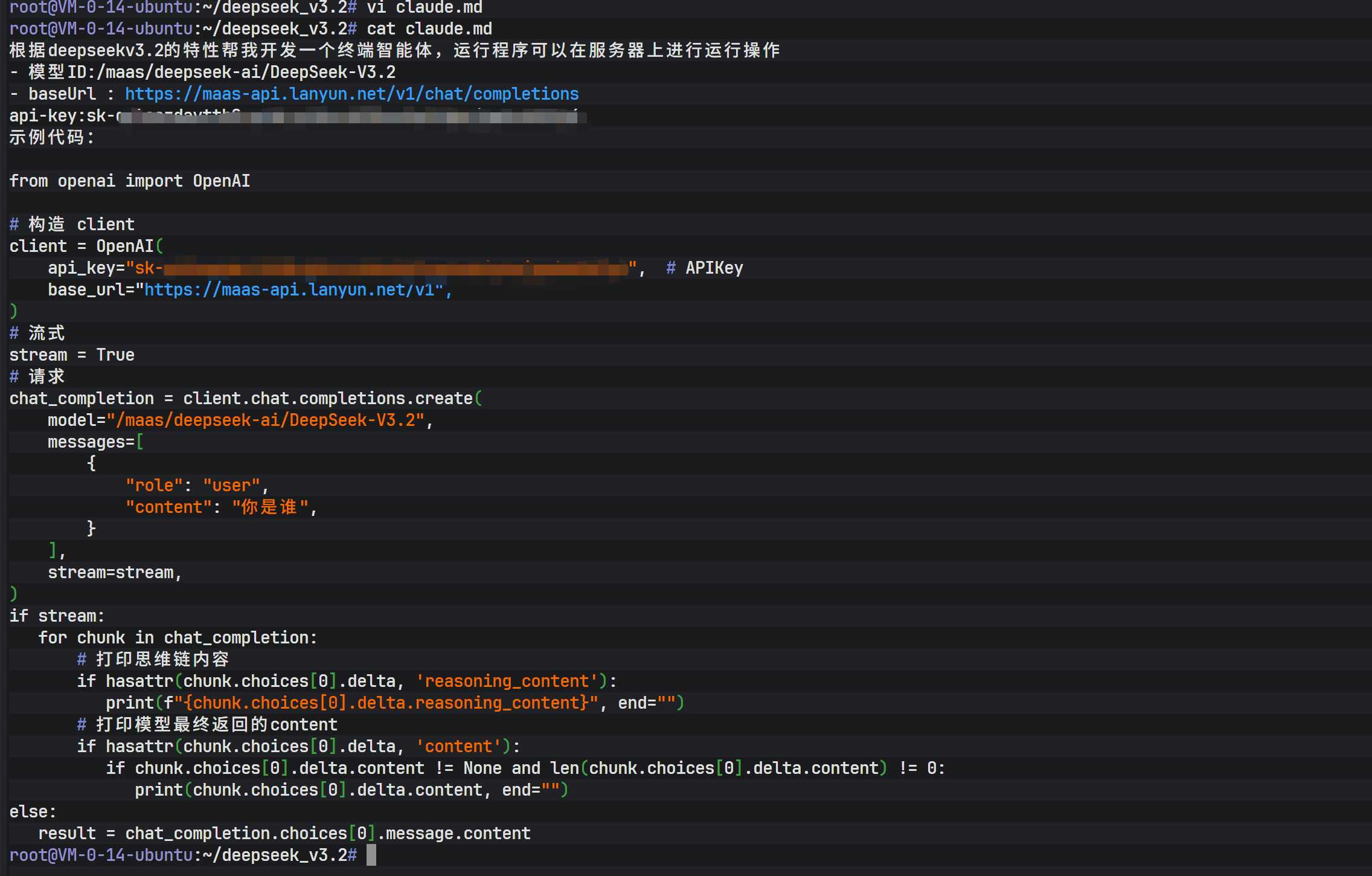

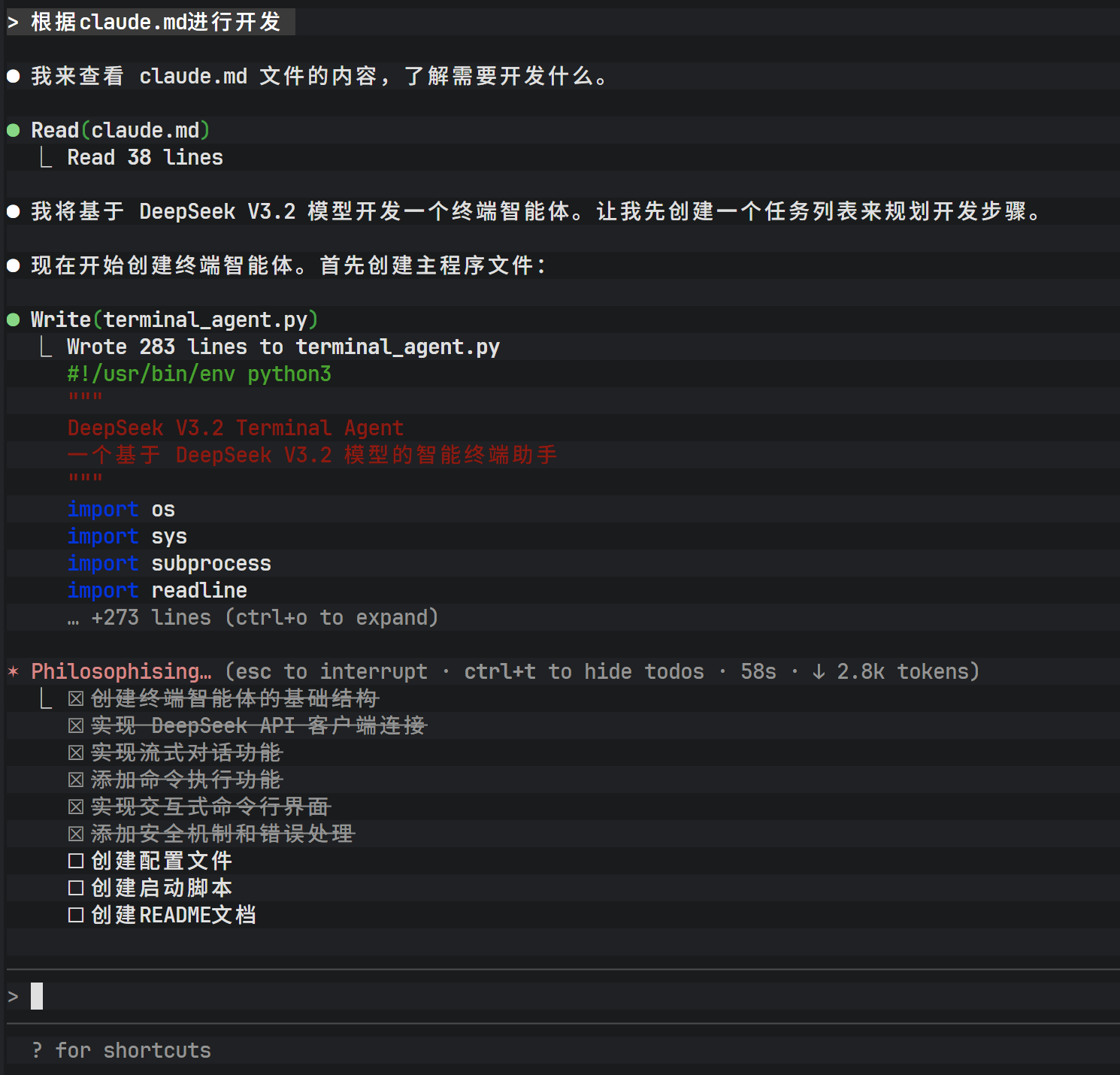

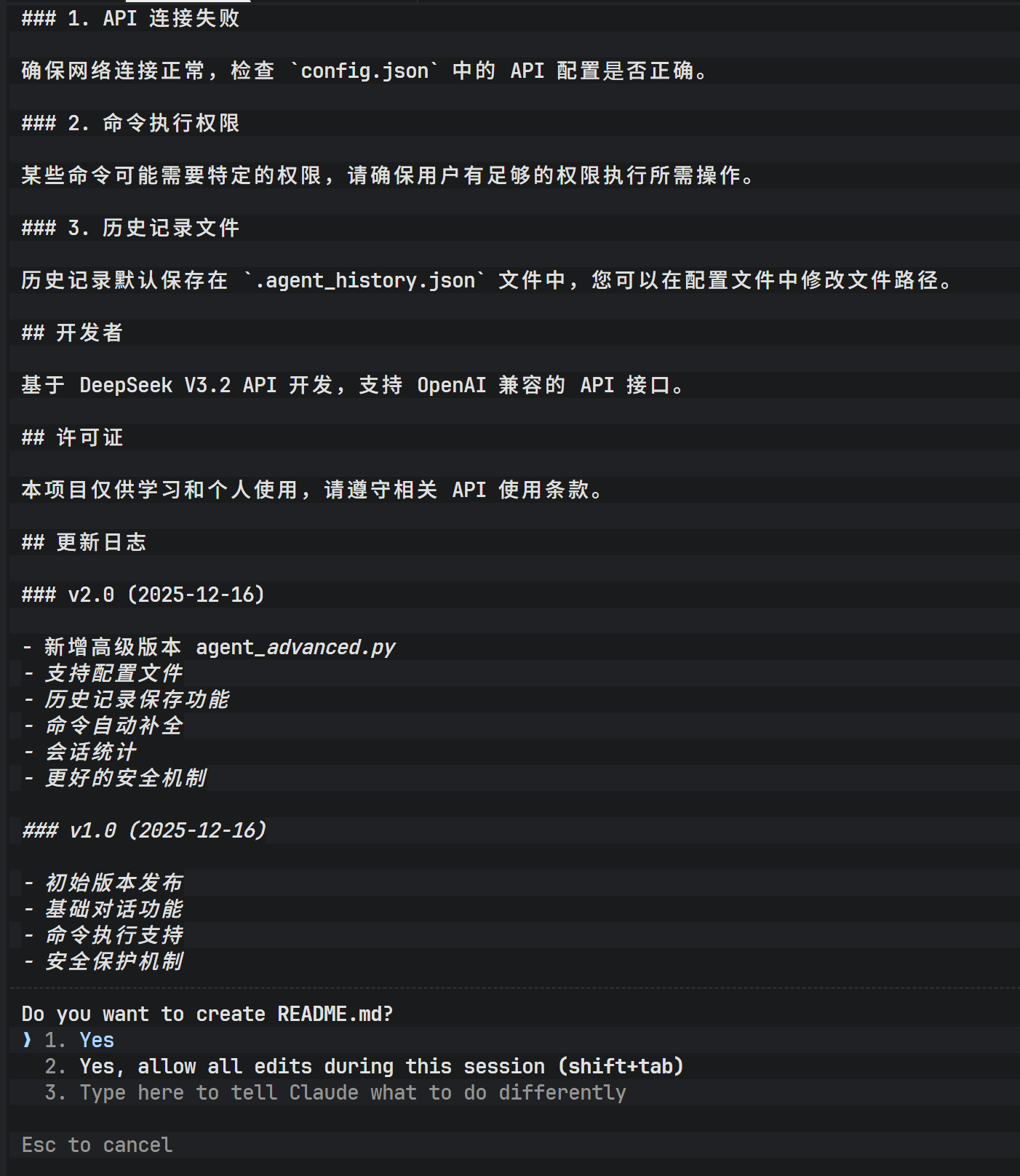

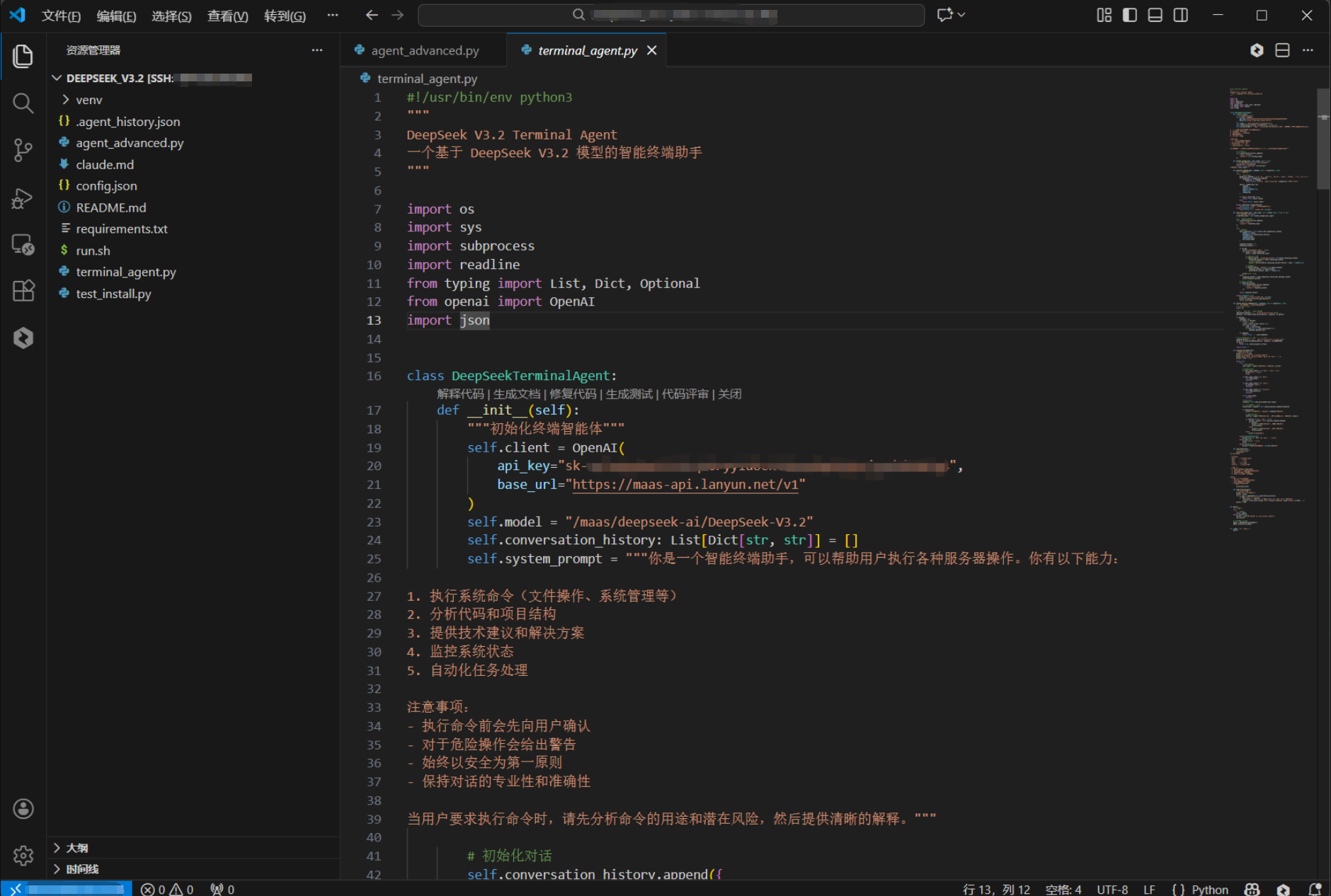

上图展示了将需求文档传递给 Claude Code 后的初始状态。紧接着,通过自然语言与 Claude Code 进行交互,指令其根据文档内容生成实际的代码文件。

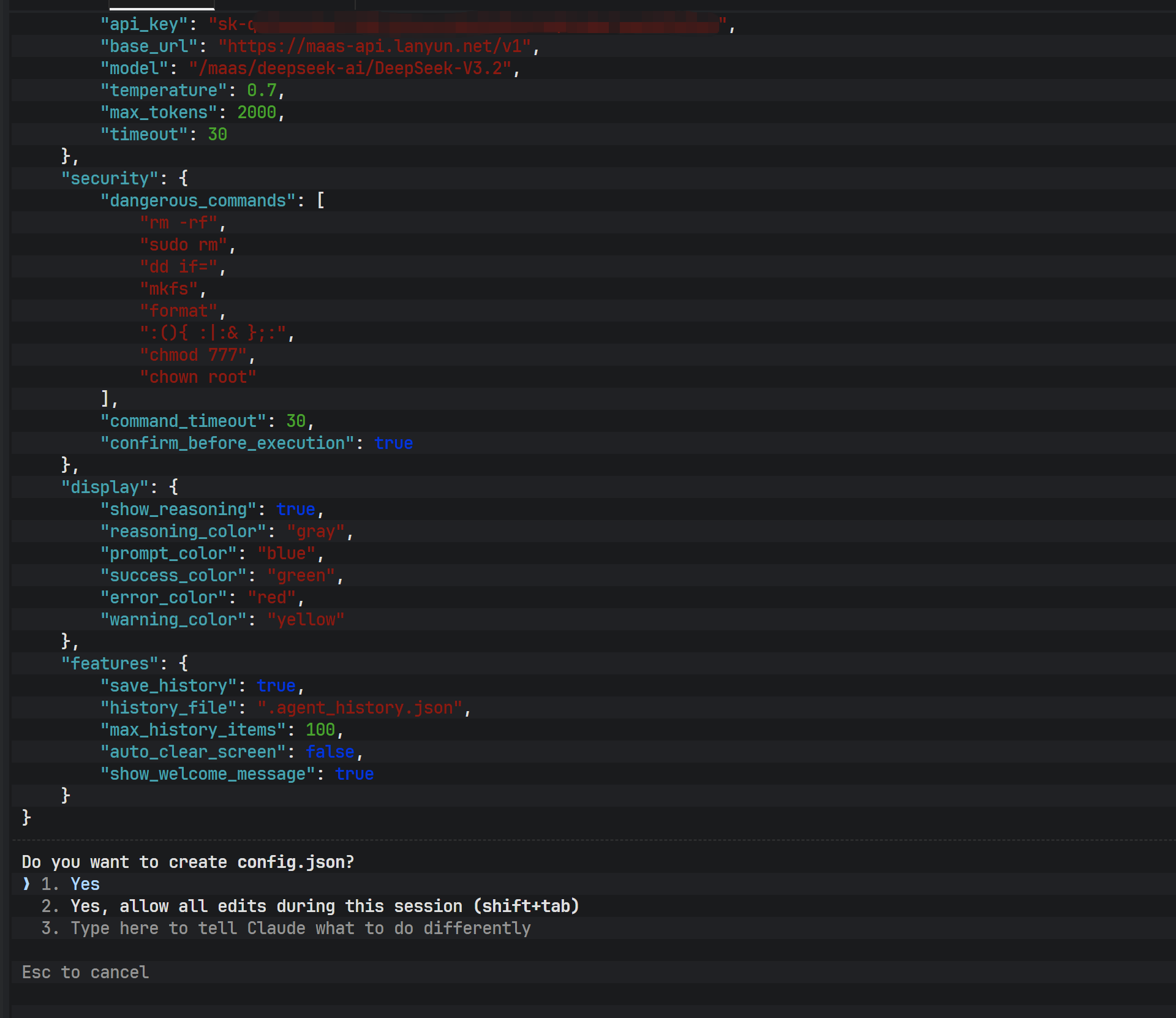

在交互过程中,Claude Code 会分析需求并列出计划创建的文件。用户需确认操作(输入 Yes),工具即开始在文件系统中生成代码。

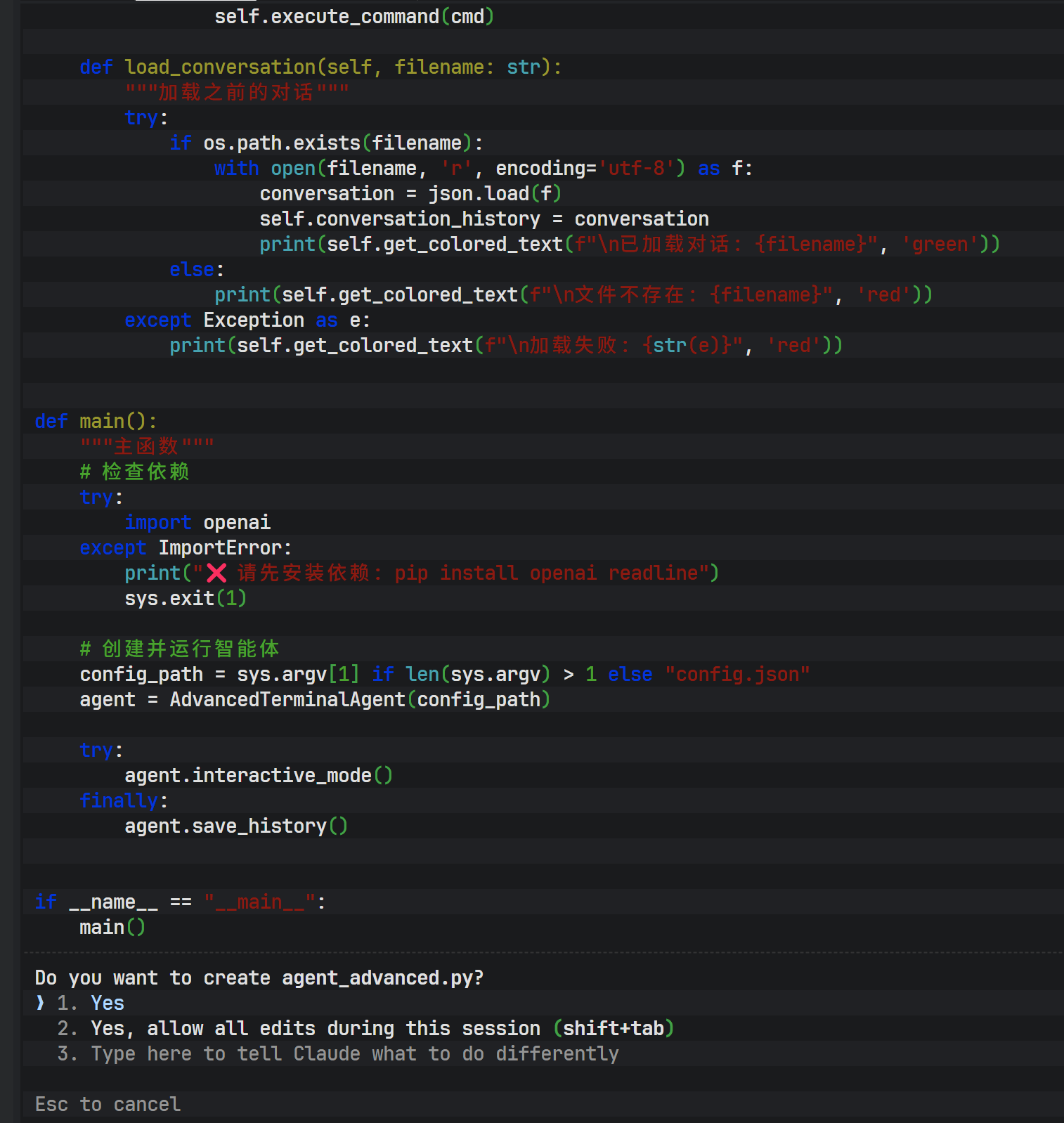

生成过程完成后,可以看到主体 Python 代码文件已被写入磁盘。此时,DeepSeek 模型不仅生成了逻辑代码,还根据上下文推断出了可能需要的辅助文件。

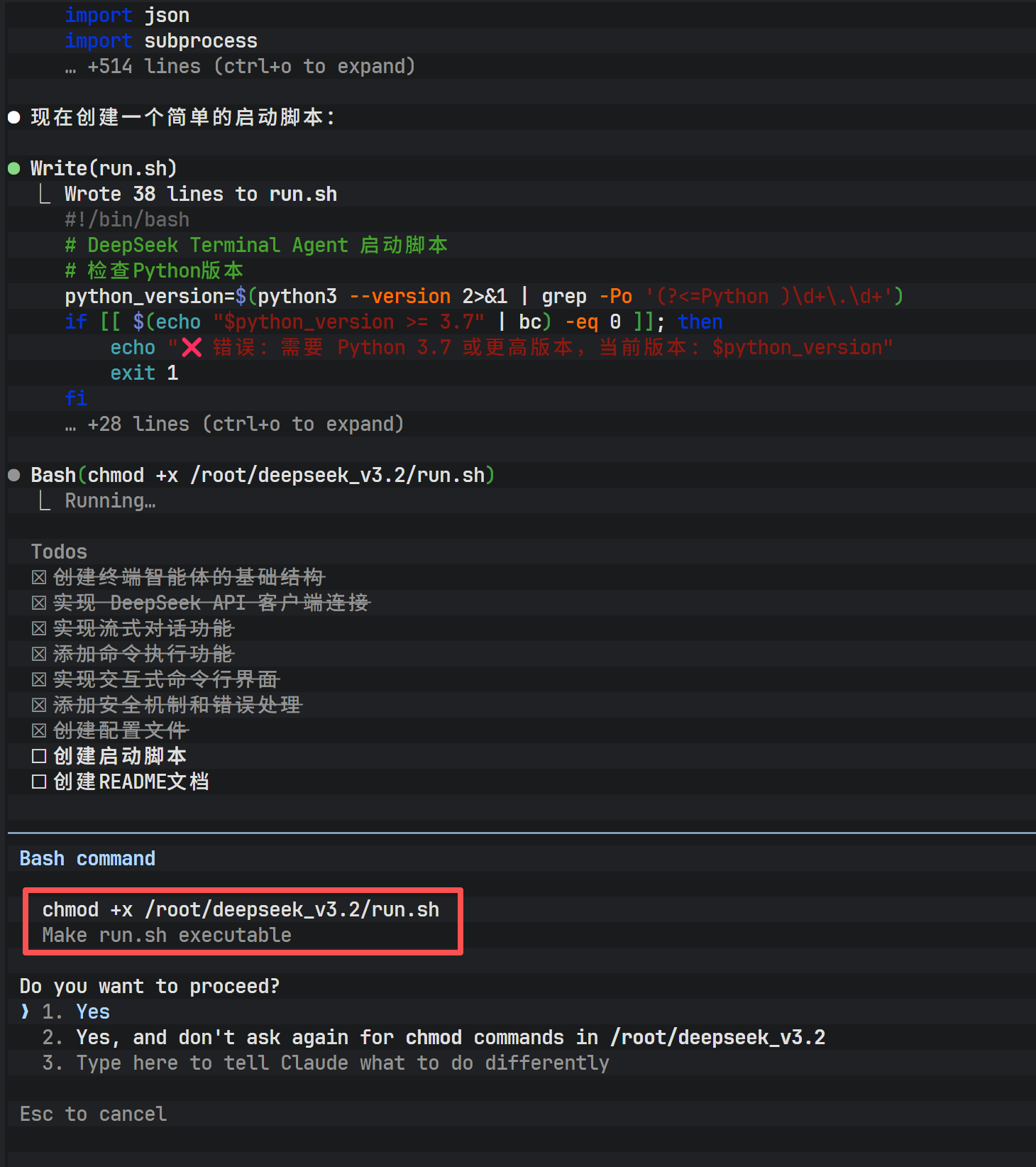

为了使生成的脚本可执行,通常需要修改文件权限。Claude Code 具备执行 shell 命令的能力,可以直接处理 chmod 操作。

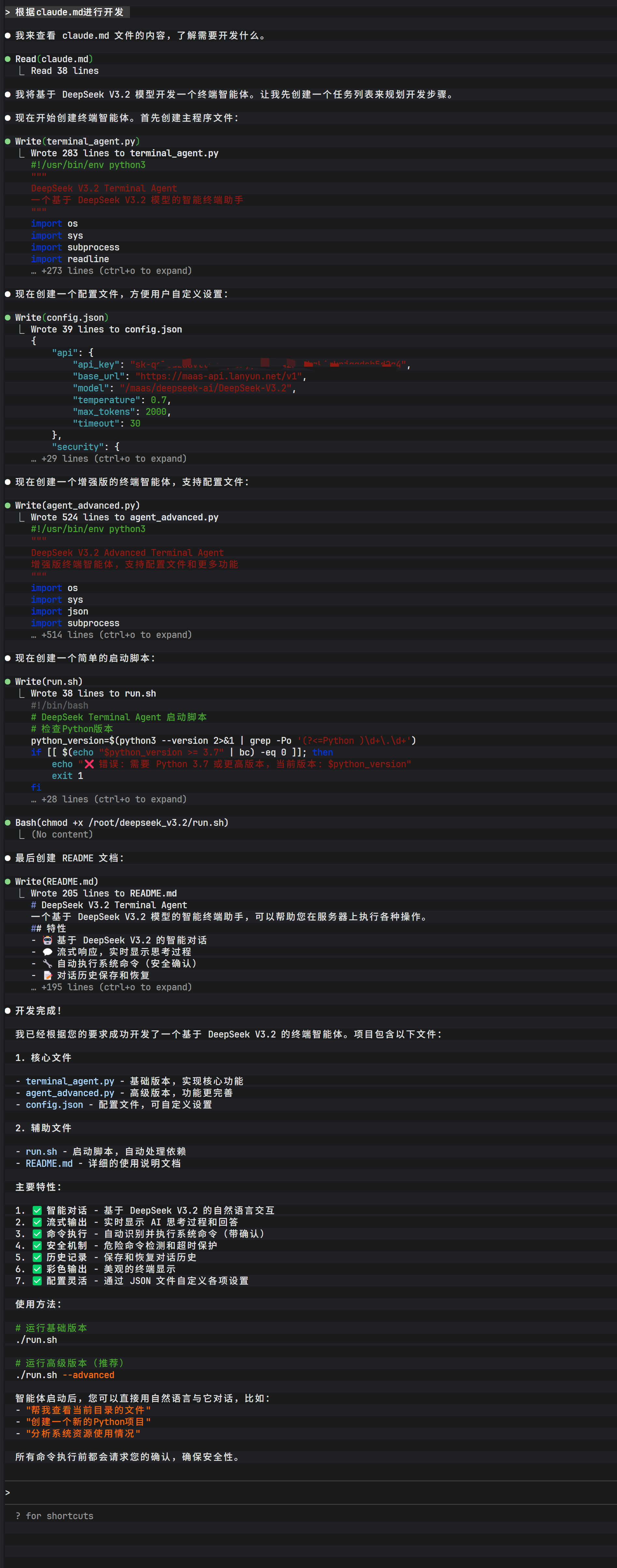

此外,完善的项目还需要文档支持。指令 Claude Code 生成 README.md 文件,它会自动根据代码逻辑生成项目说明、安装步骤及使用方法。

整个执行流程体现了极高的响应速度,这得益于蓝耘 API 的低延迟特性与 DeepSeek 模型的高效推理能力。

在项目目录中,可以找到生成的 run.sh 启动脚本。这是一个封装好的入口,用于启动刚才生成的智能体程序。

第七阶段:终端智能体运行与能力扩展

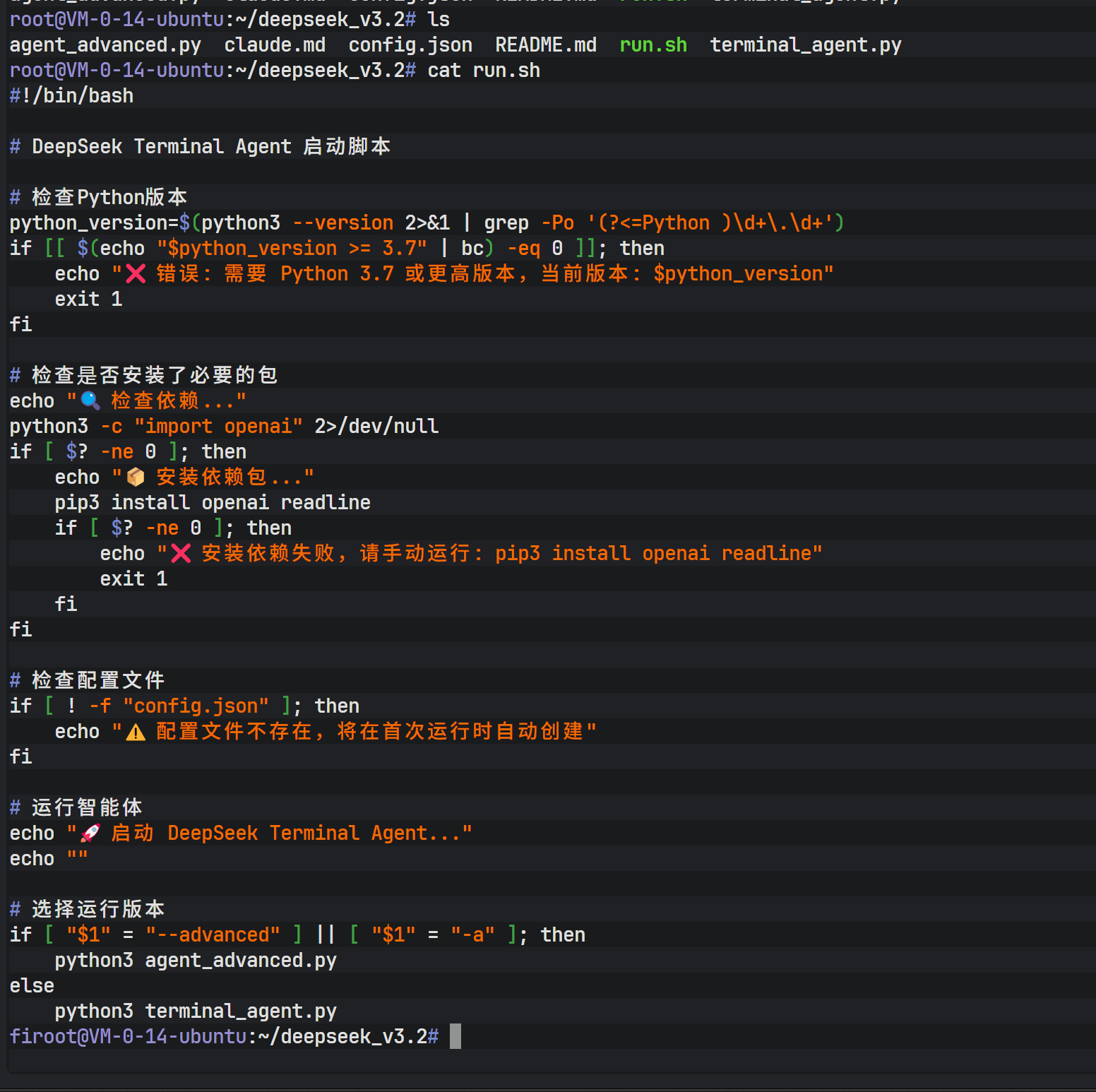

在运行生成的 Python 程序前, 需要确保已安装相关依赖:

apt install python3-pip

pip install openai readline启动后,终端智能体将提供一个类似聊天的交互界面, 但它不仅能“对话”,还能:

- 生成并修改代码文件

- 执行 Shell 命令

- 分析编译或运行错误并自动修复

- 完成创意写作、脚本生成等任务

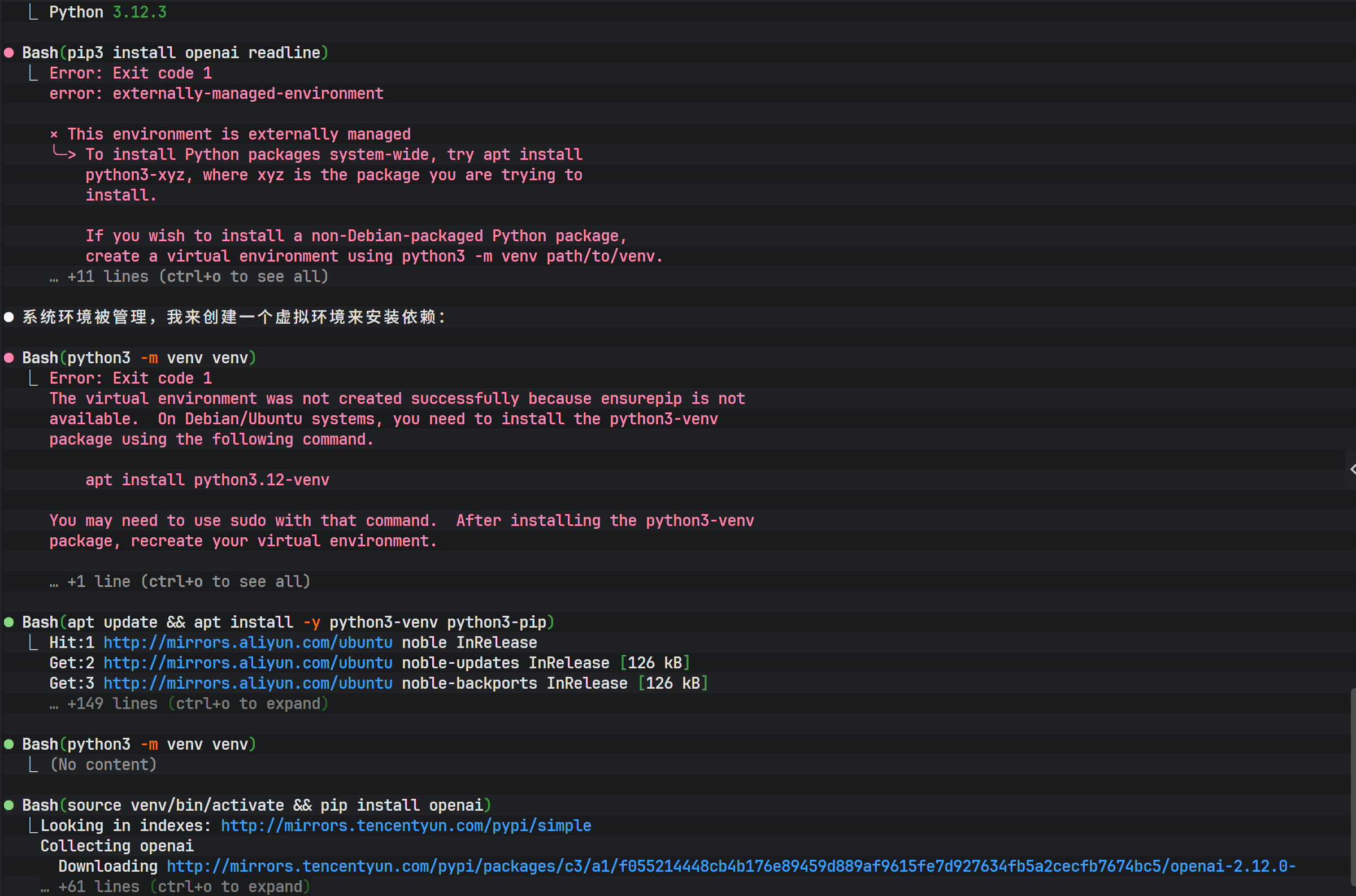

如果遇到依赖安装报错,可以再次利用 Claude Code 的能力,让 AI 分析错误日志并自动执行修复命令。这种“AI 修复 AI 环境”的模式极大地降低了运维门槛。

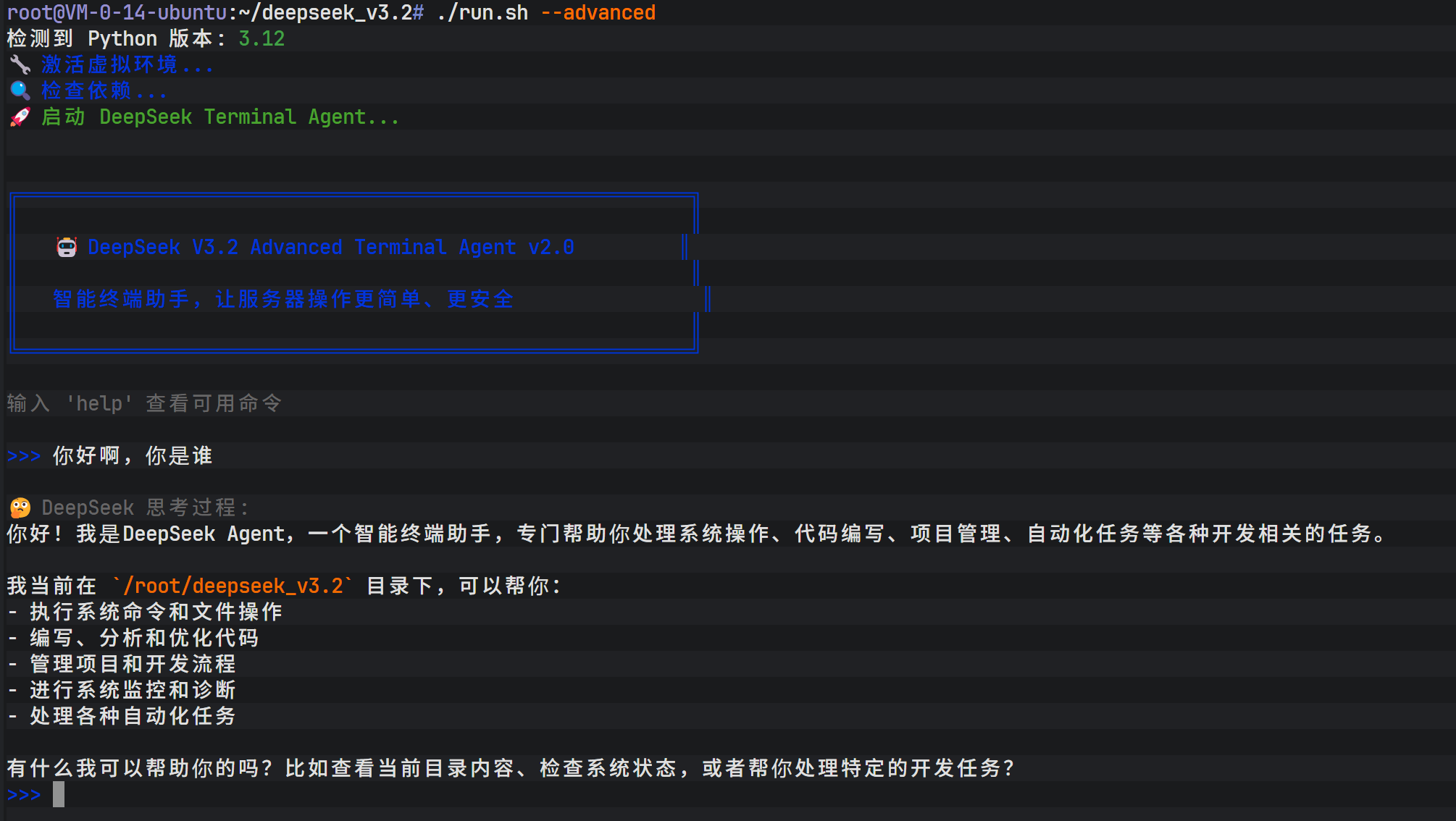

依赖解决后,启动终端智能体。界面呈现出一个交互式的对话环境,类似于 Claude 的原生界面,但其核心驱动力来自 DeepSeek V3.2。

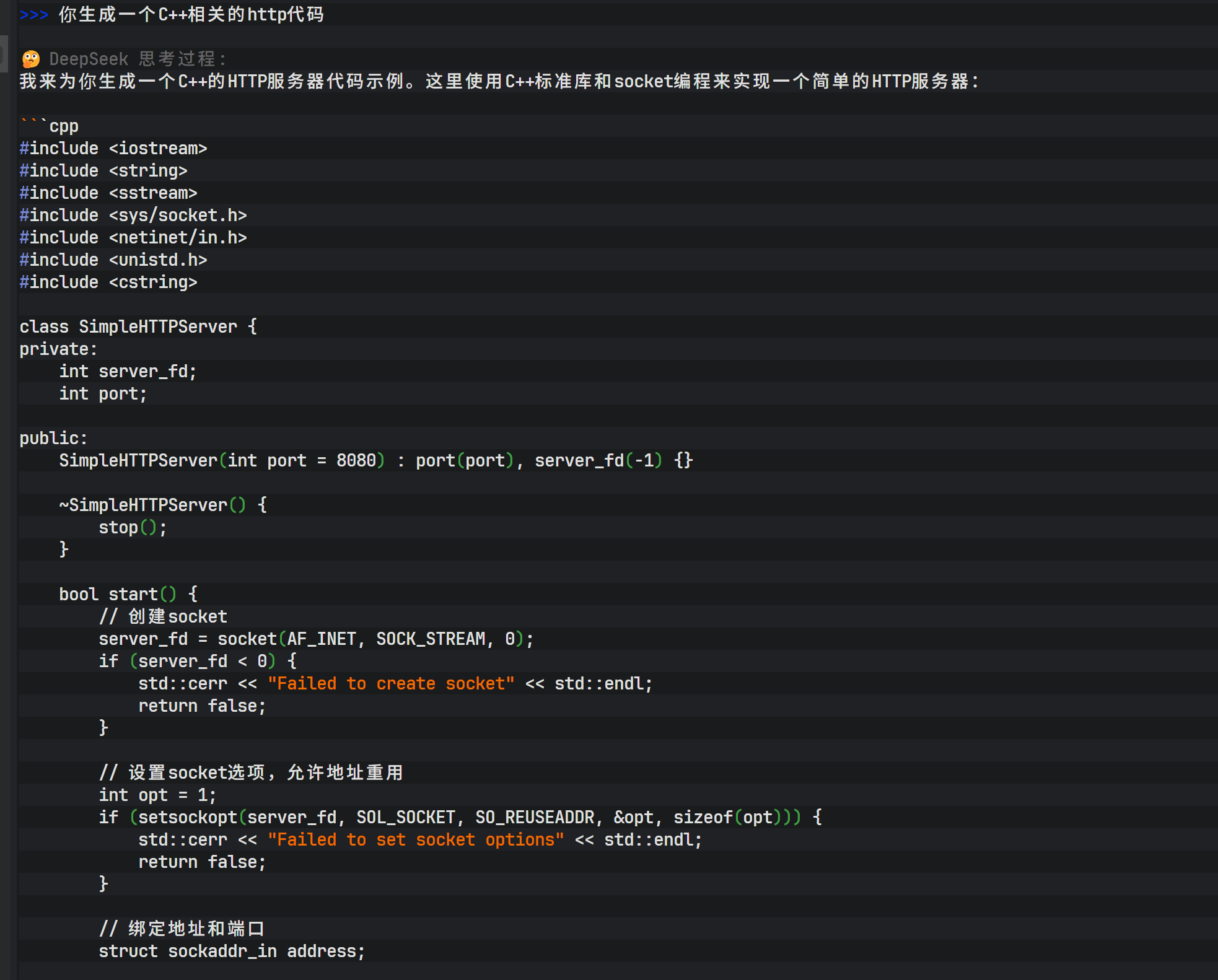

在该智能体中,可以下达复杂的编程任务,例如“生成一个 HTTP 的 C++ 代码”。模型不仅会生成 C++ 源代码,还会提供编译指令,甚至在允许的情况下直接进行编译测试。

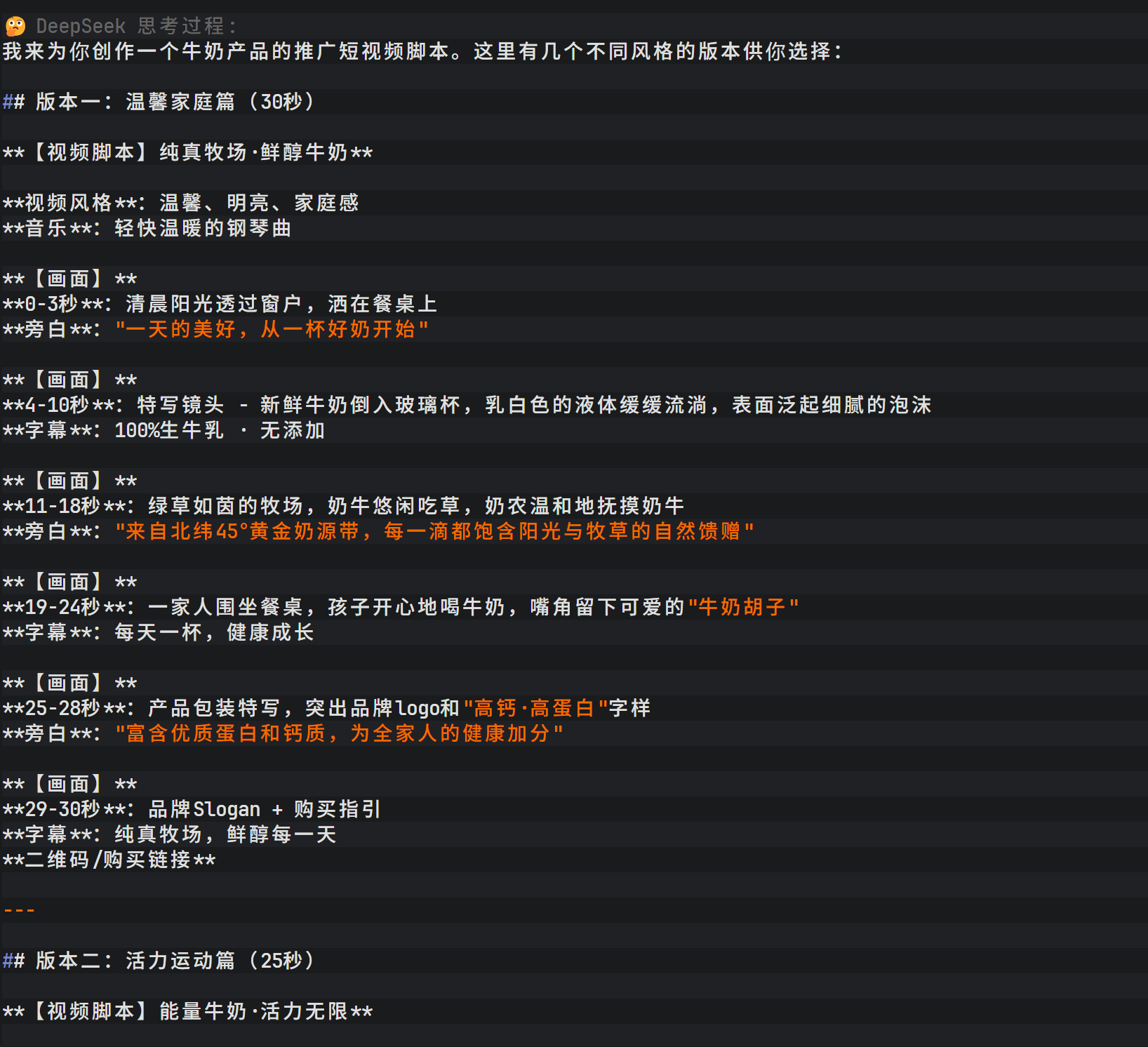

除了代码生成,该智能体还具备创意写作能力。例如输入“帮我写一个产品推广短视频脚本,产品是牛奶”,模型会迅速生成包含分镜描述、旁白文案及背景音乐建议的完整脚本。

DeepSeek V3.2 的输出不仅包含最终结果,还展示了详细的思考过程(Thinking Process),这有助于用户理解模型是如何构建逻辑的。脚本内容涵盖了多个版本(温馨家庭篇、活力运动篇、情感故事篇),并针对不同社交平台提供了拍摄建议,展现了模型在多模态场景描述上的深度。

DeepSeek V3.2 的推理过程可见性, 使得用户不仅能得到结果, 还能理解模型是如何构建逻辑的。

总结

通过以上七个阶段, 一个集成 Claude Code 与 DeepSeek V3.2 的智能终端开发环境便完整构建完成。

它不仅能够显著提升开发效率, 还通过标准化 API 接口和自动化脚本, 为未来更复杂的 AI Agent 架构提供了坚实基础。

蓝耘平台注册地址: https://console.lanyun.net/#/register?promoterCode=0131

原文链接:https://blog.csdn.net/dfssaafgds/article/details/156044458