DeepSeek 各版本说明与优缺点分析

DeepSeek 是近年来 AI 领域中最受关注的大语言模型系列之一。经过多个版本的迭代,它在不同任务上的能力不断提升。本文将详细介绍 DeepSeek 各个版本的发布时间、主要特点、优点与不足,帮助读者全面了解这一系列模型的发展脉络。

1. DeepSeek-V1:从零起步的强大编程模型

发布时间:

2024年1月

特点:

DeepSeek-V1 是该系列的首个版本,预训练数据量达到2TB,主要聚焦于自然语言处理(NLP)和编程任务,支持多种编程语言,具备较强的代码理解与生成能力,适合开发者与研究人员使用。

优点:

- 代码能力强: 支持多种编程语言,能理解与生成复杂代码,适合自动编程与调试场景。

- 上下文窗口大: 支持128K上下文,能处理更复杂的文本理解与生成任务。

缺点:

- 多模态能力有限: 主要面向文本任务,暂不支持图像与语音。

- 推理性能较弱: 在逻辑推理与复杂分析上不如后续版本。

2. DeepSeek-V2 系列:性能飞跃与开源生态

发布时间:

2024年上半年

特点:

DeepSeek-V2 拥有2360亿参数,相比V1性能大幅提升。它以“高性能、低成本”为核心,支持全开源与免费商用,极大推动了AI技术的普及与生态建设。

优点:

- 高性能低成本: 训练成本仅为GPT-4-Turbo的1%,降低了学术与商业应用的门槛。

- 完全开源可商用: 可自由部署、修改与微调,促进了开放生态的发展。

缺点:

- 推理速度偏慢: 虽然性能强大,但推理速度不及后续版本。

- 多模态能力仍有限: 仍以文本为主,不支持图像、音频输入。

3. DeepSeek-V2.5:数学与联网能力突破

发布时间:

2024年9月

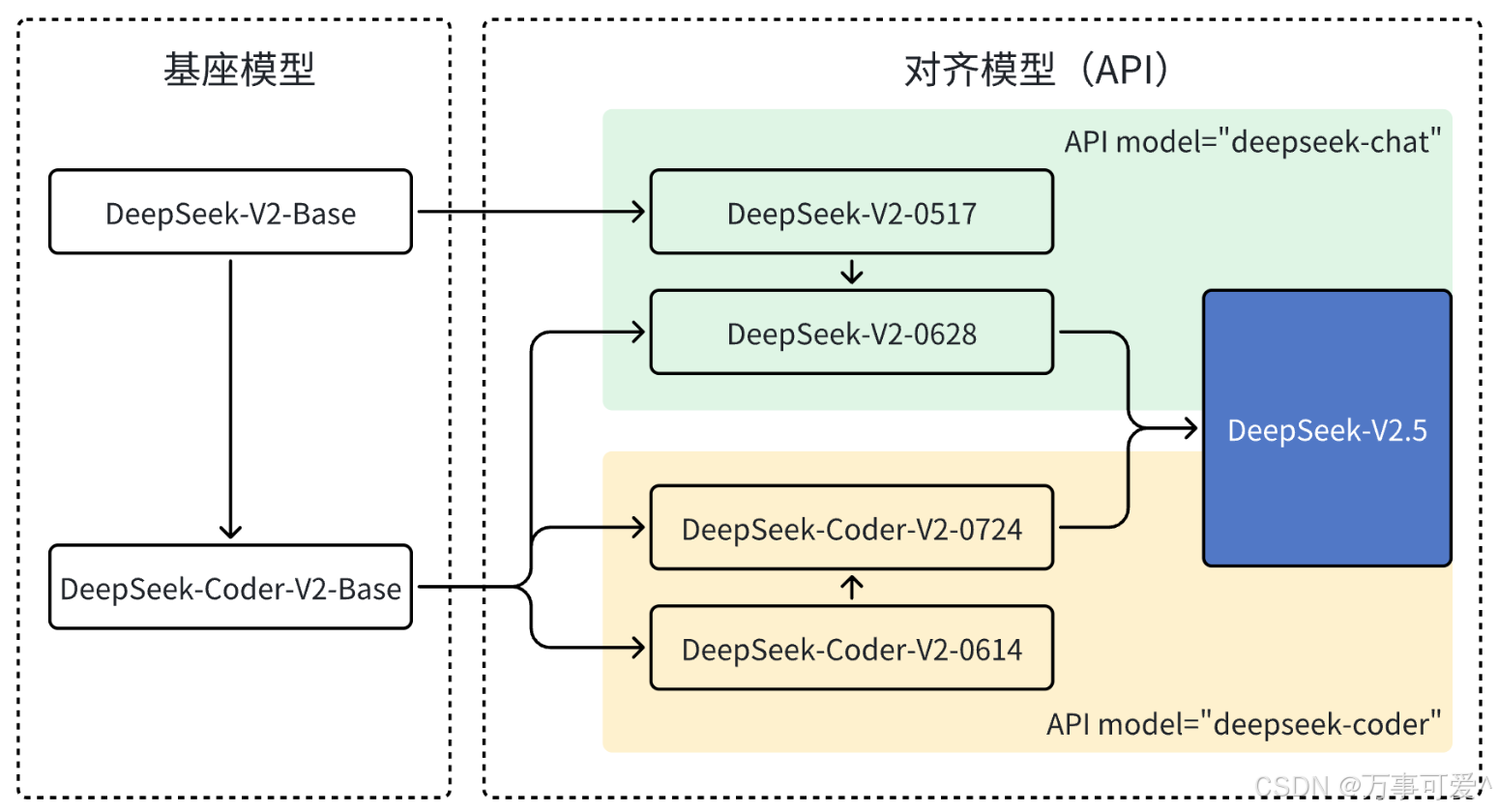

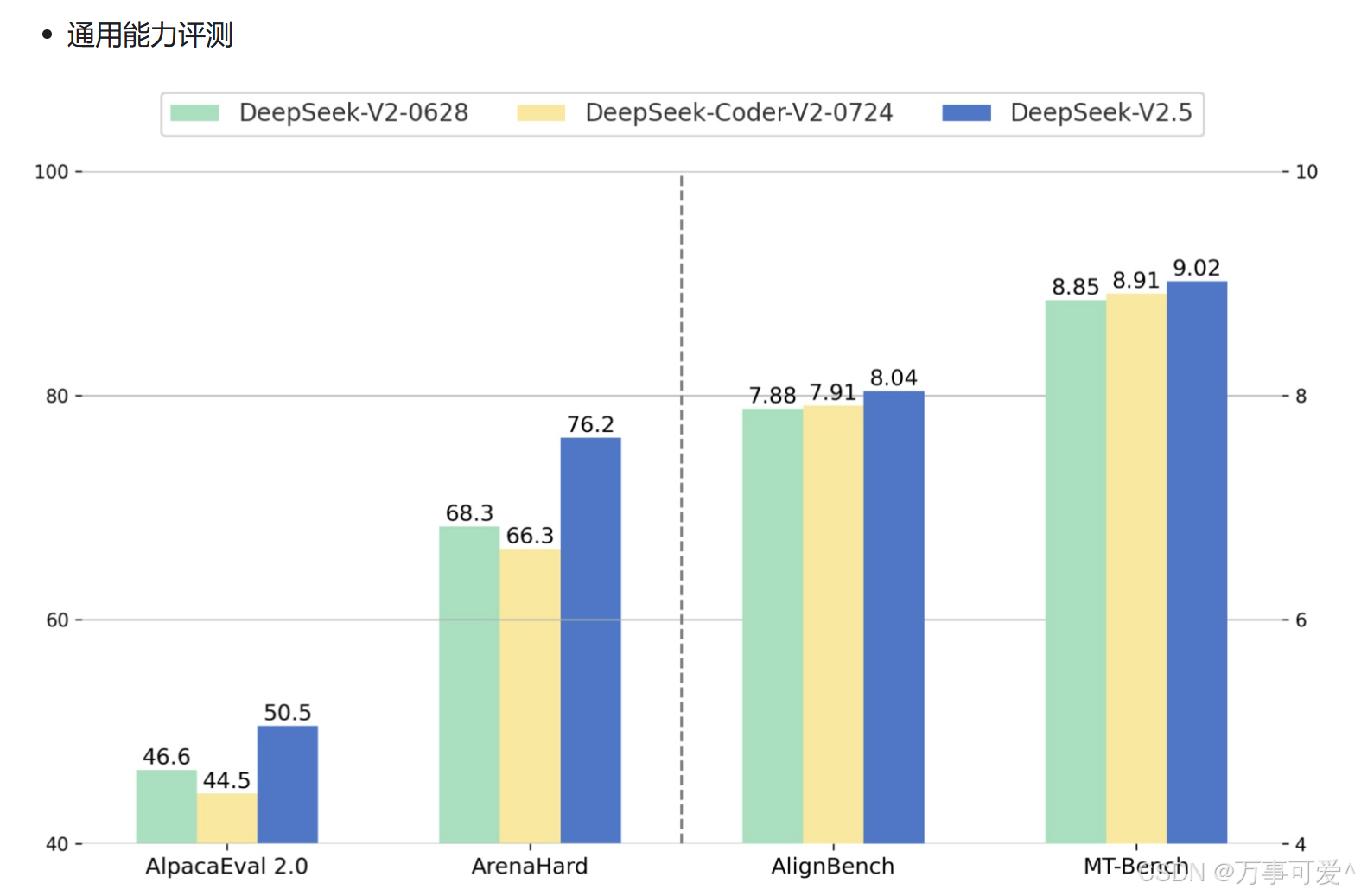

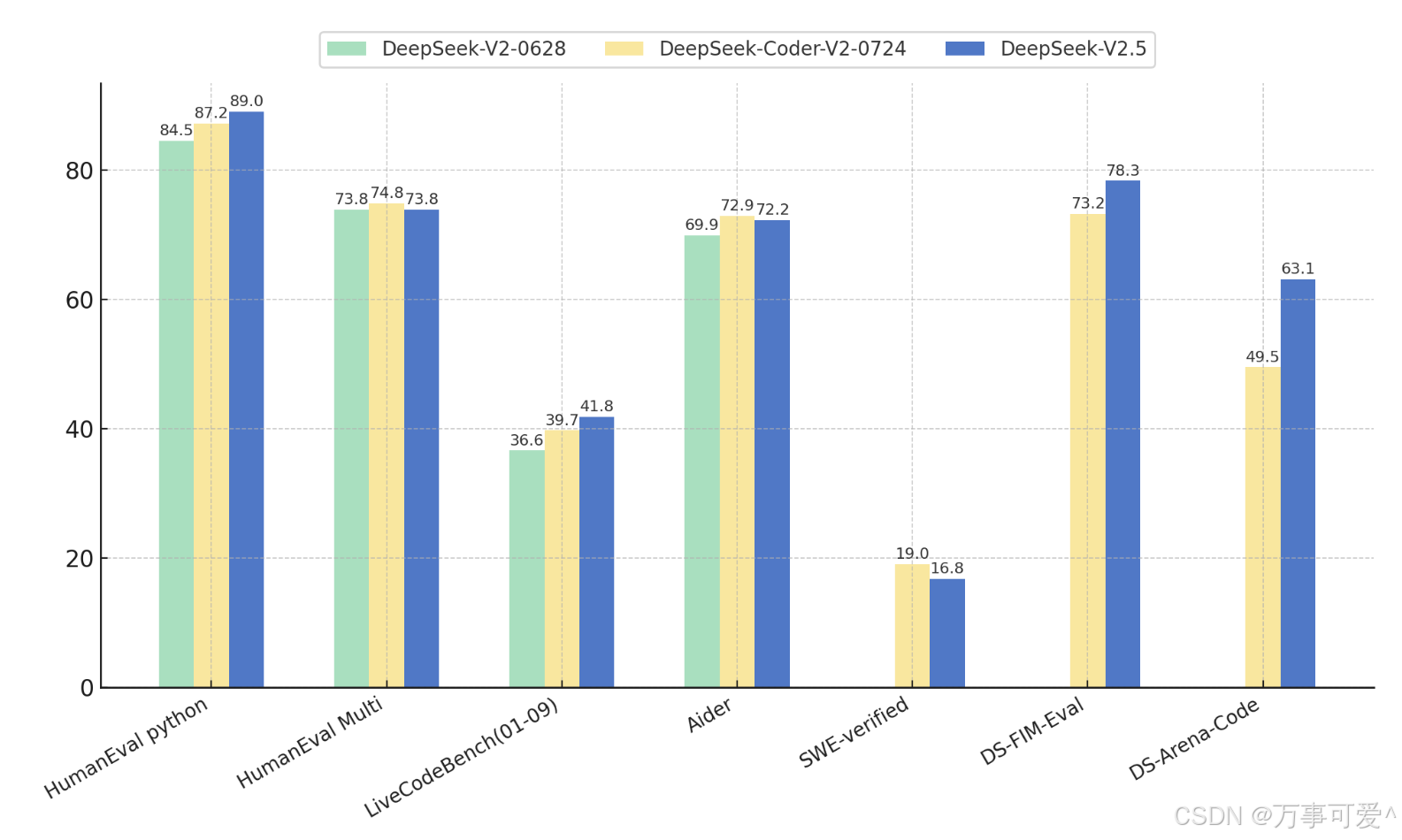

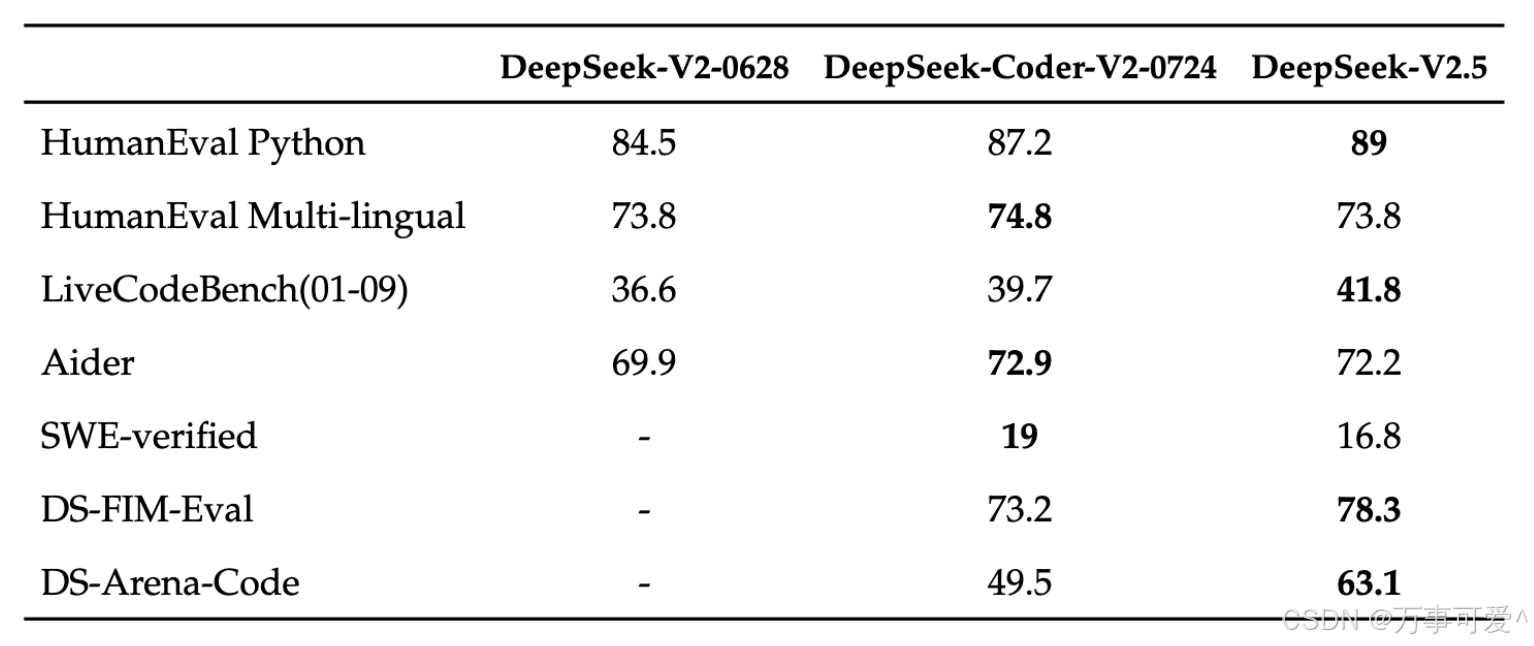

DeepSeek 团队在此版本中将 Chat 与 Coder 模型合并,大幅提升了综合能力与代码推理能力。Chat 模型主攻通用对话与创作,Coder 模型专注于编程任务,两者结合后,V2.5 在问答、创作等任务上较V2有明显提升。

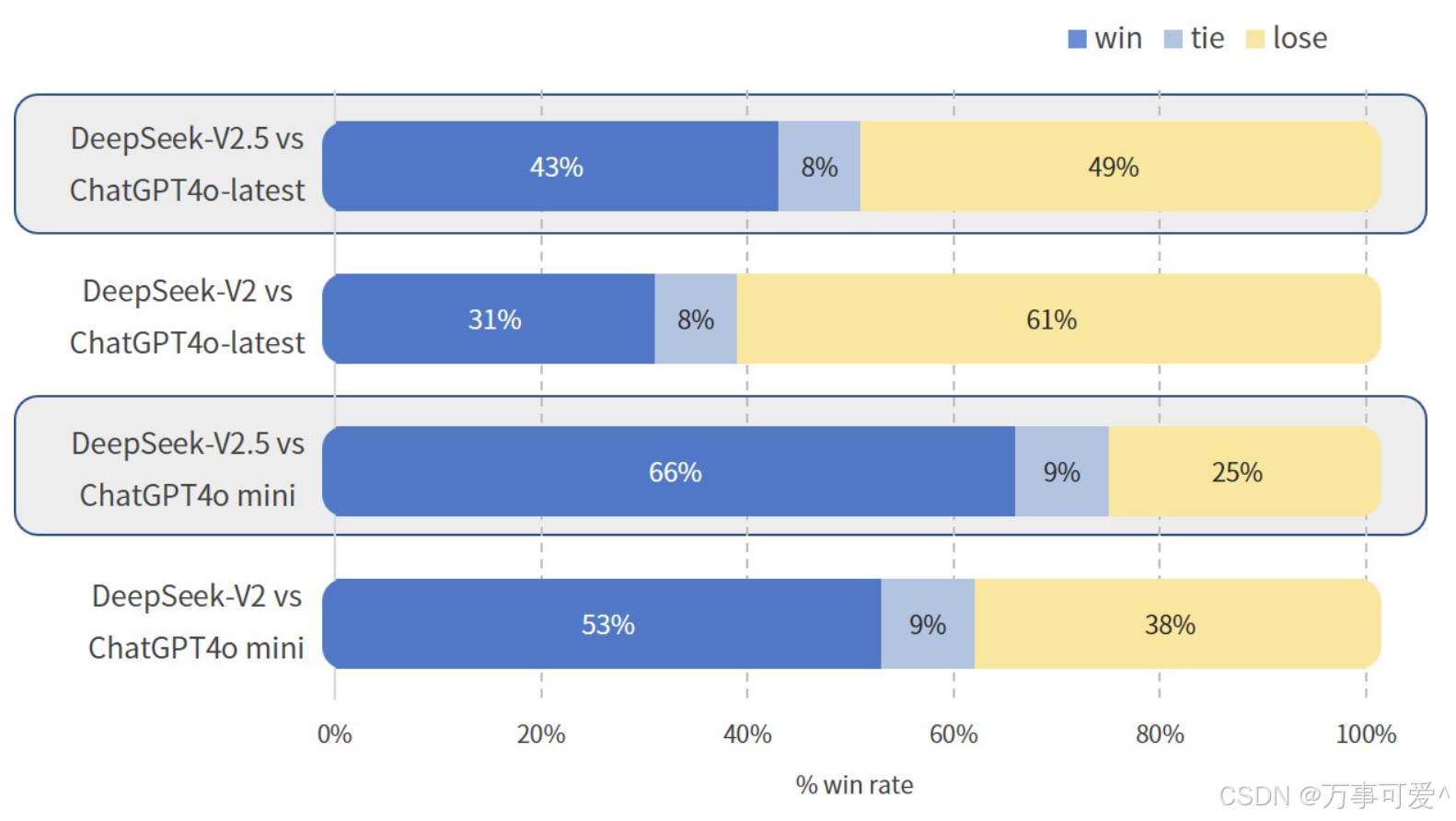

对比结果:

- DeepSeek-V2.5 对比 ChatGPT-4o-latest:43%胜率,8%持平,49%失利。

- DeepSeek-V2 对比 ChatGPT-4o-latest:31%胜率,8%持平,61%失利。

- DeepSeek-V2.5 对比 ChatGPT-4o-mini:66%胜率,9%持平,25%失利。

- DeepSeek-V2 对比 ChatGPT-4o-mini:53%胜率,9%持平,38%失利。

特点:

DeepSeek-V2.5 在数学推理与写作能力上有重大提升,并引入了联网功能(Web Search),能实时查询资料,增强信息的时效性与准确性。

优点:

- 数学与写作能力显著增强: 推理准确度与表达质量提升明显。

- 支持联网搜索: 可访问实时互联网信息,提升回答的准确性。

缺点:

- API暂不支持联网功能: 公共API用户无法直接使用。

- 多模态能力仍不足: 尚未支持图像等多模态任务。

开源地址:

https://huggingface.co/deepseek-ai/DeepSeek-V2.5

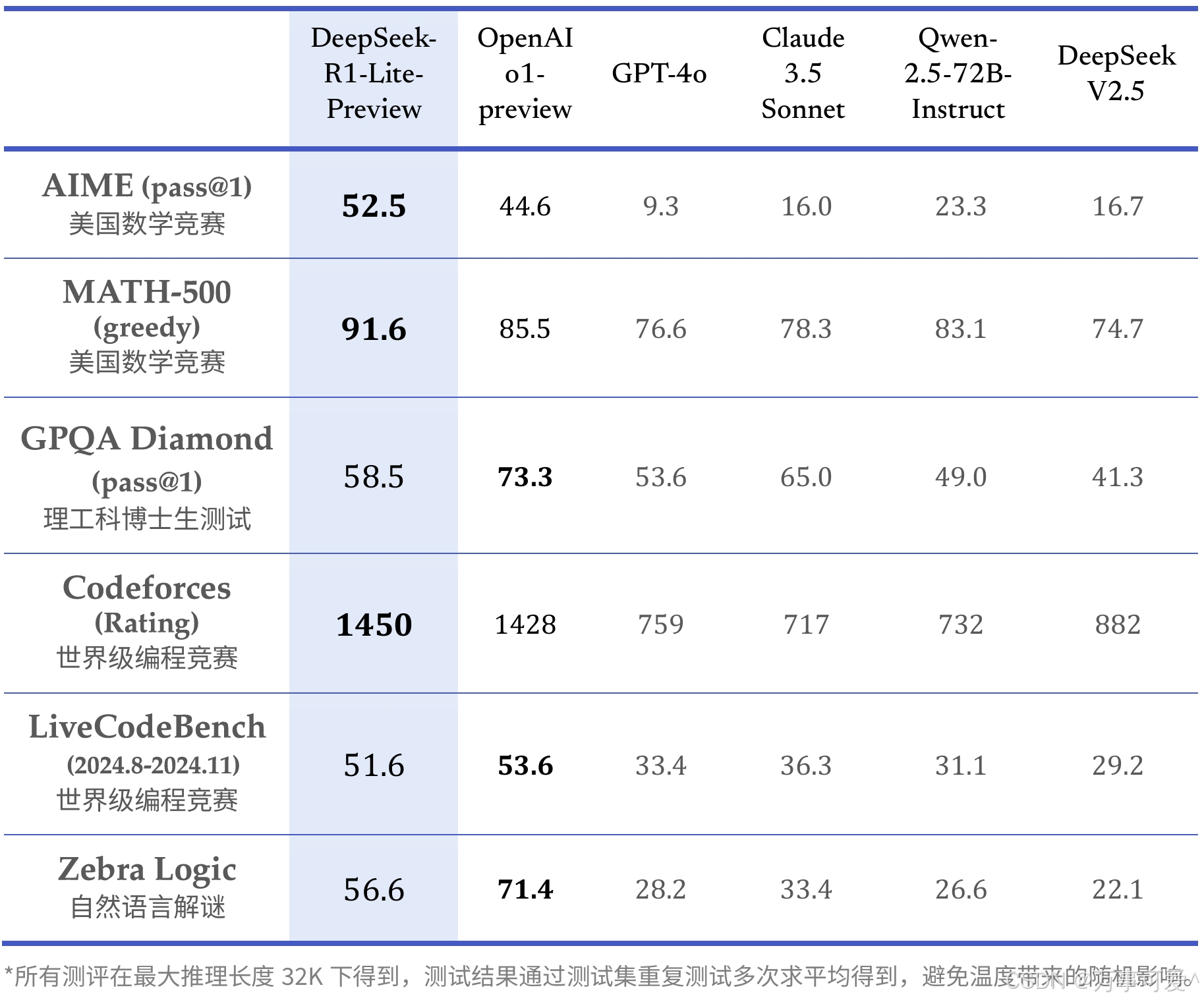

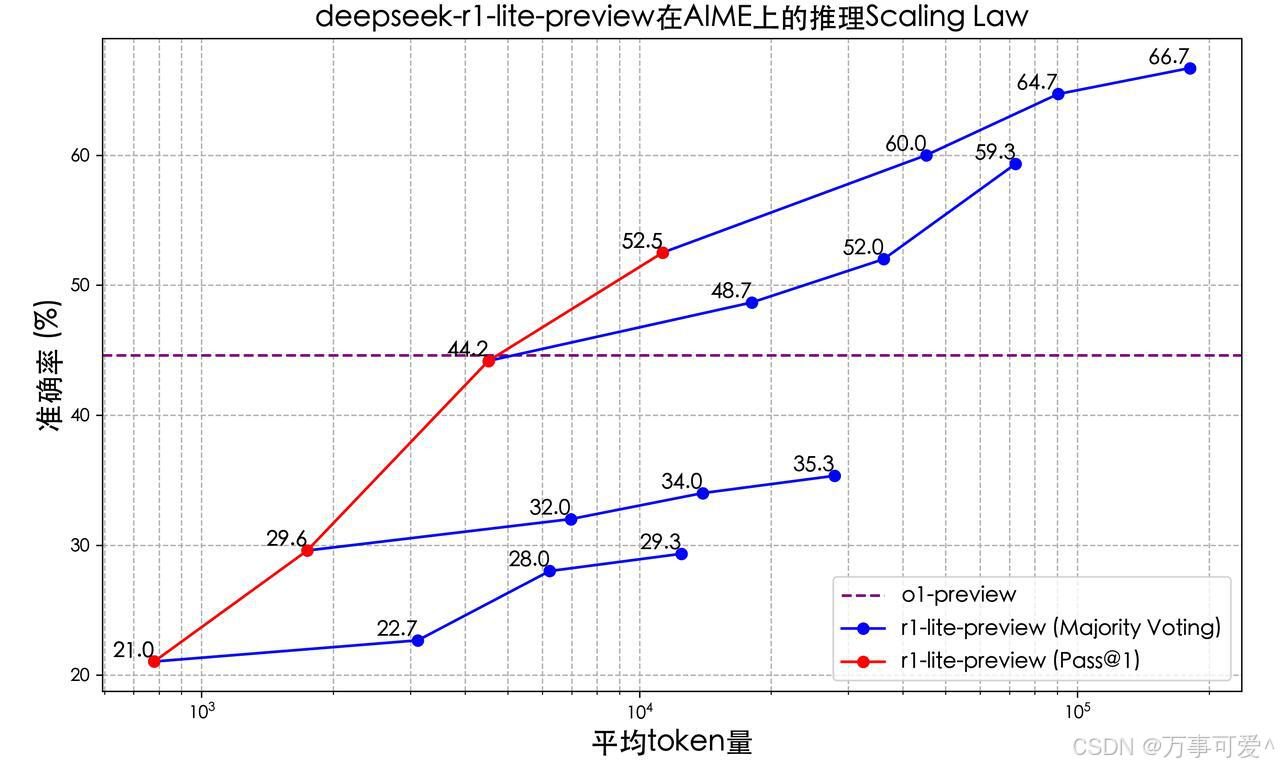

4. DeepSeek-R1-Lite:推理模型预览版(对标 o1)

发布时间:

2024年11月20日

DeepSeek-R1-Lite 是 R1 系列的预览版,采用强化学习(RL)训练,主打“长推理链”。在数学、逻辑、编程任务中表现优异,多项测试超越 GPT-4o。

特点:

采用长链式推理,推理步数可达数万token,具备较强的数学、逻辑与编程能力。

优点:

- 推理能力强: 在逻辑推理、数学计算等方面表现优于 GPT-4o 与 o1。

- 推理过程可视化: 输出包含完整思考链,透明可验证。

- 成本较低: 相比同级别模型训练成本更低。

缺点:

- 代码生成稳定性差: 在简单编程任务中偶有不稳定。

- 事实召回能力不足: 不擅长时事与外部知识类问题。

- 中英混合输出: 有时出现中英文混杂的推理内容。

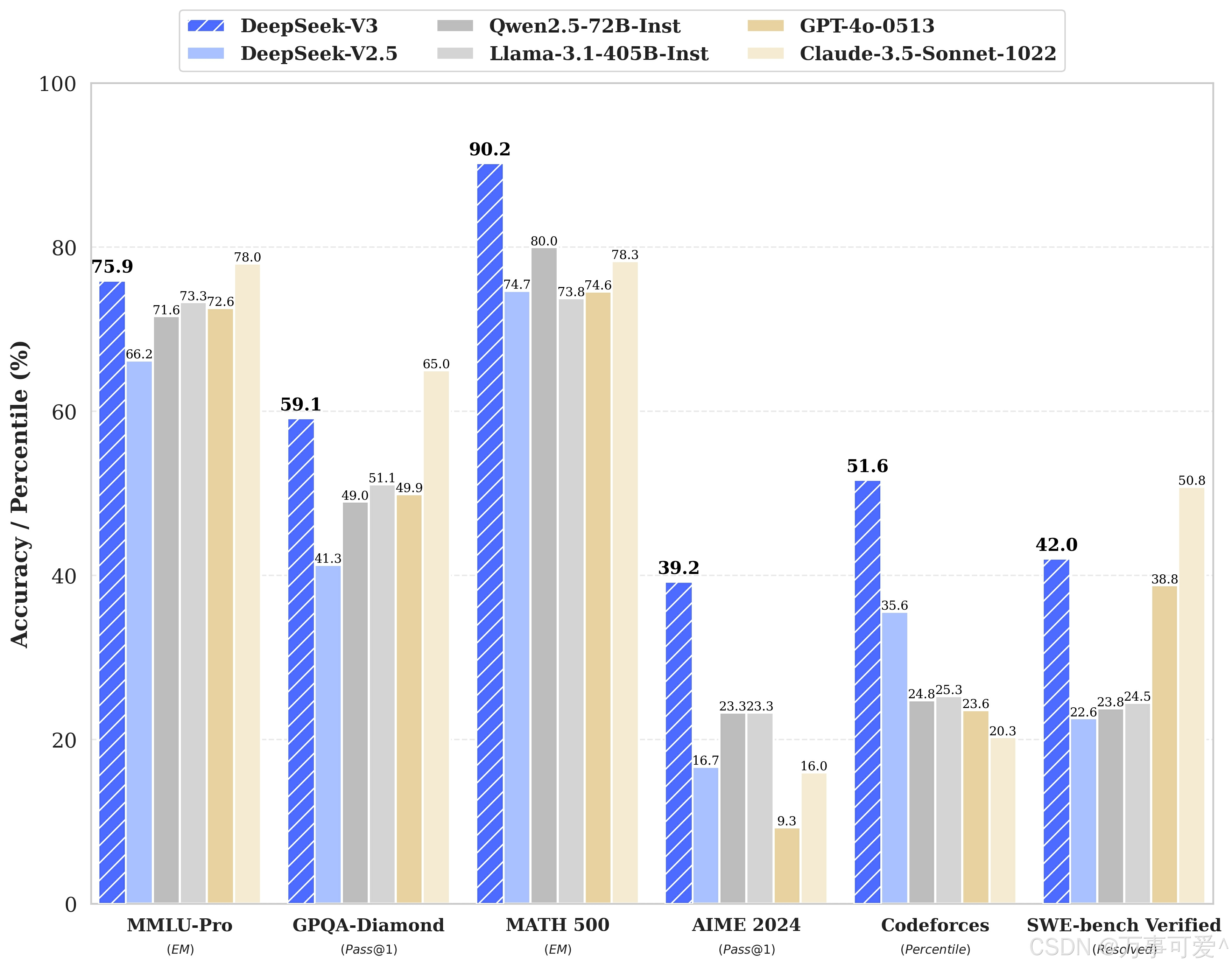

5. DeepSeek-V3:规模更大、速度更快的旗舰模型

发布时间:

2024年12月26日

特点:

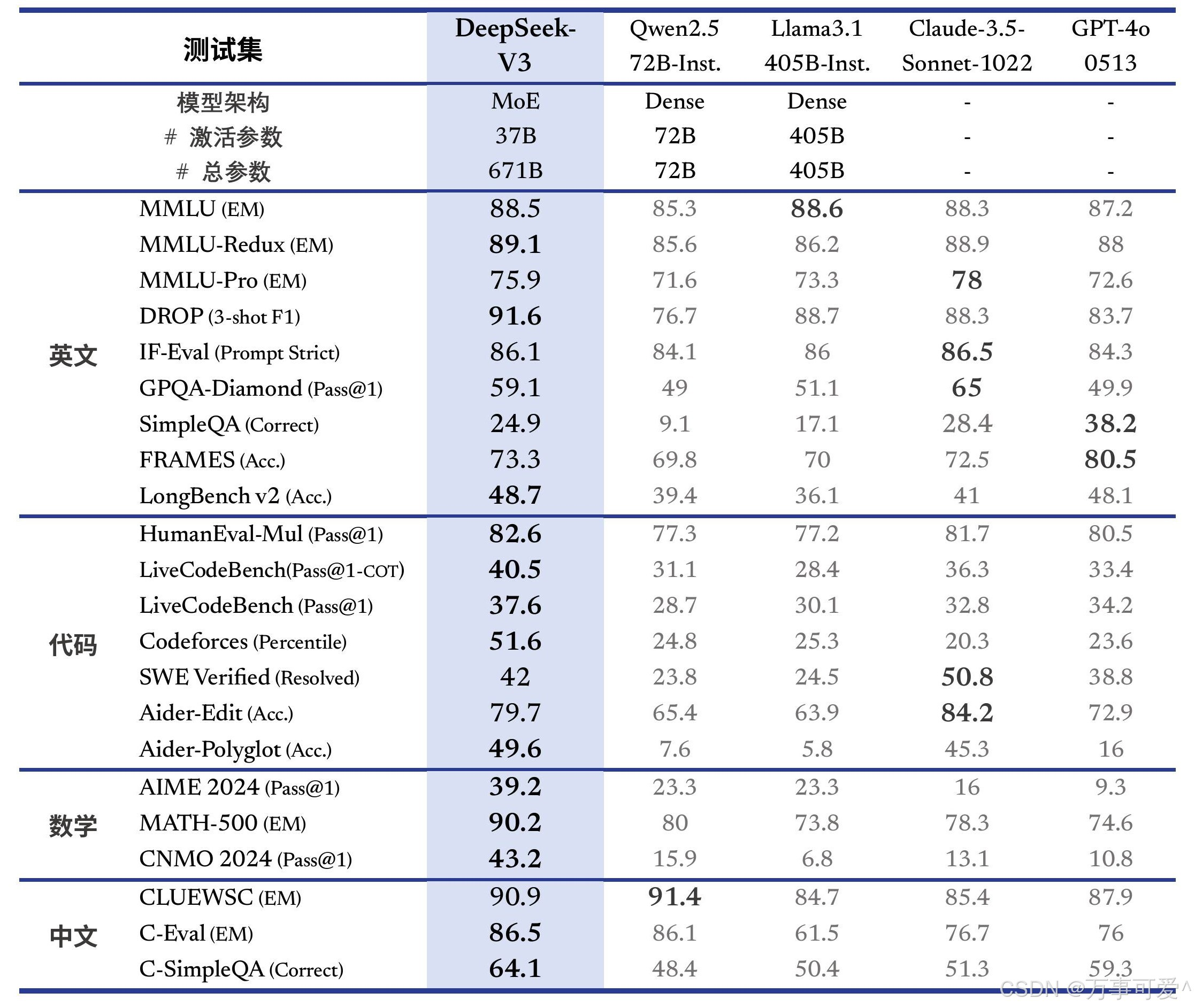

DeepSeek-V3 采用混合专家模型(MoE)架构,总参数6710亿,激活参数370亿。性能全面超越V2.5,在数学、推理、编程等方面接近 GPT-4o 与 Claude-3.5-Sonnet。

优点:

- 推理能力极强: 在知识问答与数学逻辑方面表现突出。

- 生成速度快: 输出速度达60 tokens/s,是V2的三倍。

- 支持本地部署: 提供FP8权重,便于隐私控制与定制化。

缺点:

- 算力要求高: 训练需大量GPU资源。

- 多模态仍未完善: 暂不支持图像、语音输入。

论文地址:

DeepSeek-V3 Paper

6. DeepSeek-R1:强化学习与科研级推理(对标 OpenAI o1)

发布时间:

2025年1月20日

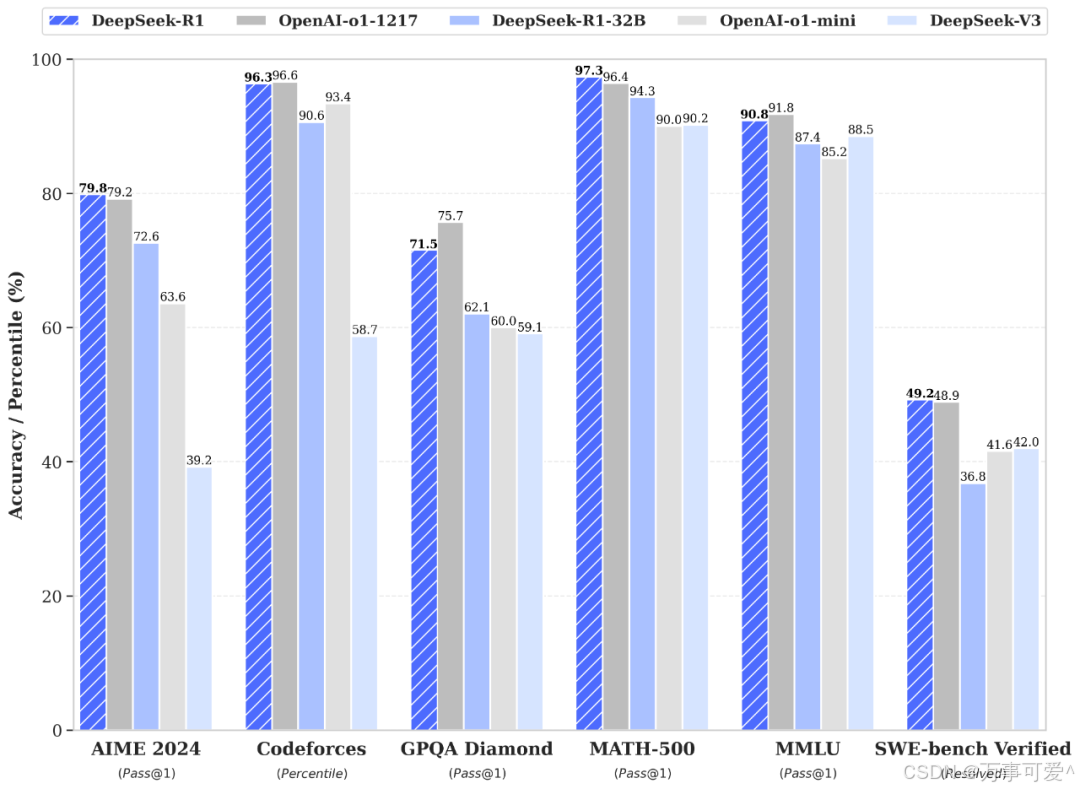

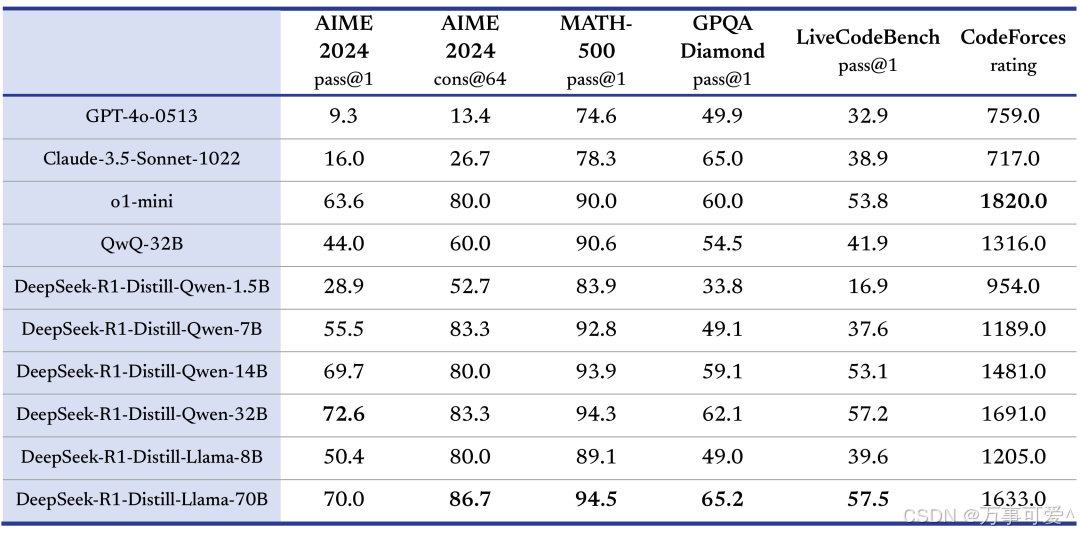

DeepSeek-R1 是目前最先进的版本,采用大规模强化学习训练,全面开放MIT开源许可。用户可自由微调或蒸馏训练轻量模型。

优点:

- 强化推理能力: 在数学、逻辑、编程等任务上与 OpenAI o1 相当。

- 完全开源: 允许学术研究与自定义微调,支持知识蒸馏。

- API支持: 可通过

model='deepseek-reasoner'输出完整思考链。

缺点:

- 多模态能力仍不足: 仅限文本任务。

- 应用场景偏研究: 更适合科研与教学使用。

论文地址:

DeepSeek-R1 Paper